1. Introducción a los servidores de aplicaciones y a WildFly

1.1. ¿Qué es un servidor de aplicaciones?

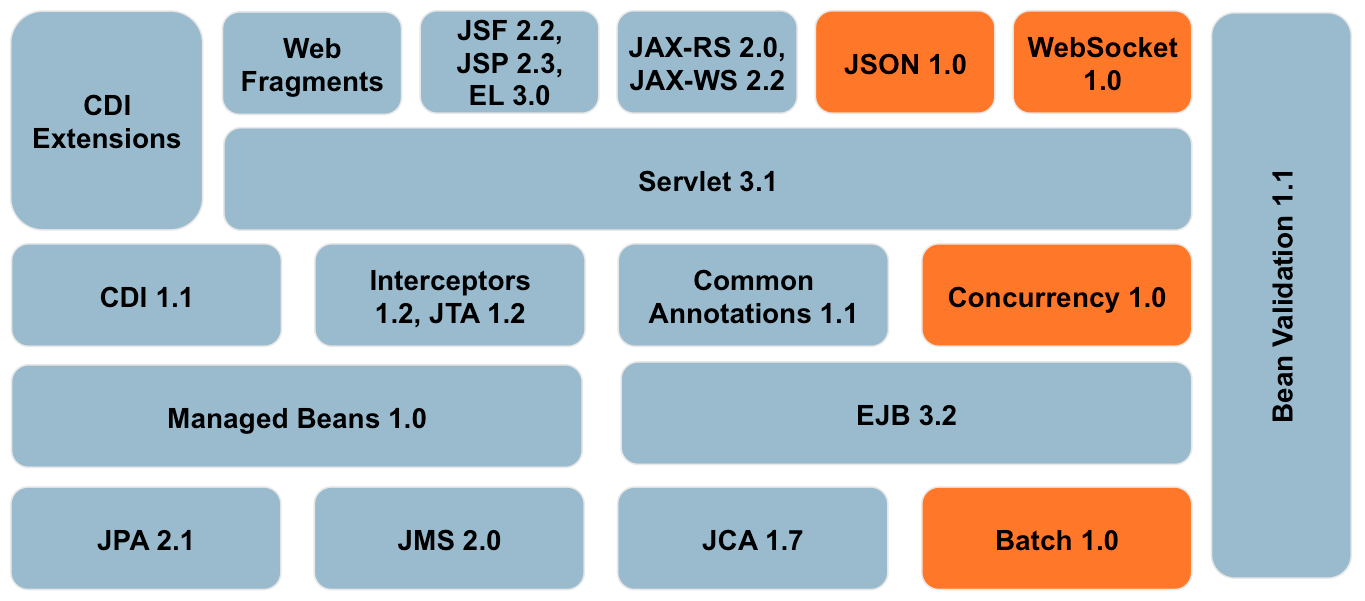

Un servidor de aplicaciones es una plataforma que implementa los servicios definidos en la especificación de Java Enterprise.

Estos servicios van desde la ejecución de aplicaciones web sencillas, basadas en Servlets/JSP hasta aplicaciones distribuidas con soporte transaccional, basadas en Enterprise Java Beans (EJB) o servicios Web.

| Especificación | Java EE 6 | Java EE 7 |

|---|---|---|

Servlet |

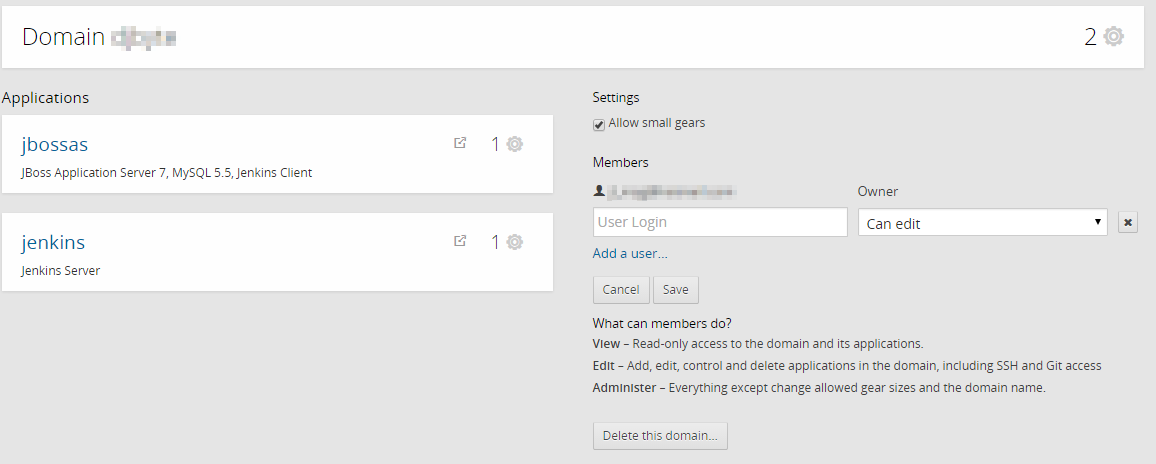

3.0 |

3.1 |

JavaServer Pages (JSP) |

2.2 |

2.3 |

Unified Expression Language (EL) |

2.2 |

3.0 |

Debugging Support for Other Languages (JSR-45) |

1.0 |

1.0 |

JavaServer Pages Standard Tag Library (JSTL) |

1.2 |

1.2 |

JavaServer Faces (JSF) |

2.0 |

2.2 |

Java API for RESTful Web Services (JAX-RS) |

n/a |

2.0 |

Java API for WebSocket (WebSocket) |

n/a |

1.0 |

Java API for JSON Processing (JSON-P) |

n/a |

1.0 |

Common Annotations for the Java Platform (JSR-250) |

1.1 |

1.2 |

Enterprise JavaBeans (EJB) |

3.1 Lite |

3.2 Lite |

Java Transaction API (JTA) |

1.1 |

1.2 |

Java Persistence API (JPA) |

2.0 |

2.1 |

Bean Validation |

1.0 |

1.1 |

Managed Beans |

1.0 |

1.0 |

Interceptors |

1.1 |

1.2 |

Contexts and Dependency Injection (CDI) |

1.0 |

1.1 |

|

¿Se puede considerar Tomcat un servidor de aplicaciones?

Tomcat implementa un contenedor Web que en su versión 8 cumple las especificaciones Servlet 3.1, JSP 2.3, y EL 3.0 y WebSockets, pero no incluye un contenedor de EJB’s o da soporte a otras APIs como JMS, por tanto no se puede considerar como un servidor de aplicaciones completo.

|

Sí que es cierto es que de la combinación de Tomcat con Spring, junto con otras librerías de terceros resulta en algo parecido a un servidor de aplicaciones. Es más, proyectos como Spring Boot o DropWizard permiten integrar dentro de un único fichero, tanto código de aplicación como los servicios que necesita para funcionar.

La principal ventaja de un servidor de aplicaciones es que integra todo los componentes necesarios para empezar a trabajar, permitiendo al programador centrarse en lo más importante que es el desarrollo de aplicaciones. Esto no quiere decir que no podamos utilizar las librerías que creamos oportunas, pero el producto ya nos ofrece una solución válida en conjunto.

Para un administrador de sistemas también es más sencillo pues al ser un producto estándar, puede trabajar sobre el servidor sin necesidad de conocer los entresijos de las aplicaciones que ejecutan.

|

¿Debemos entonces debemos utilizar un servidor de aplicaciones para todo?

No necesariamente, puesto que la administración y configuración de un Tomcat, Jetty u otros servidores es más sencilla, siempre y cuando nuestra aplicación no requiera de servicios más avanzados. Por otra parte si nuestro desarrollo es muy específico puede compensar el invertir tiempo y desarrollar una solución a medida con librerías y/o frameworks alternativos.

|

Lo que nos debe llevar a pensar en utilizar un servidor de aplicaciones es considerar que cuestiones como la estandarización, la alta disponibilidad, la monitorización del rendimiento, transaccionalidad y seguridad son importantes en nuestros desarrollos así como el poder centrarnos en resolver un problema abstrayéndonos de los servicios que vamos a utilizar.

La especificación Java EE 7 se publicó en mayo de 2013 pero no es hasta finales de 2015 cuando se puede considerar como instaurada. La propia Oracle certifica su producto comercial WebLogic en Octubre de 2015 y RedHat, a fecha de redacción de estos apuntes aún no ha publicado una versión comercial certificada.

- Los más importantes son

-

-

Comerciales: Oracle WebLogic, IBM WebSphere, Red Hat JBoss EAP.

-

Open Source: Oracle GlassFish, RedHat WildFly.

-

Hace unos años la respuesta a esta pregunta era más sencilla, pero hoy en día con la cantidad de información disponible y la madurez de los productos Open Source actuales es complicado el amortizar los costes de licencias, sobre todo en el caso de nuevos desarrollos basados en Java EE 6 o 7.

1.2. Evolución de Java Enterprise

Desde sus inicios, la especificación Java Enterprise ha intentado definir y estandarizar los servicios que una aplicación de negocio necesita, y a lo largo de sus primeras versiones fue añadiendo nuevas tecnologías, si bien el desarrollo de aplicaciones era bastante complejo.

Los primeros servidores de aplicaciones de algún modo emulaban el modelo de Mainframe ya conocido en aplicaciones de grandes empresas pero especializado en la ejecución de aplicaciones java y suponían un coste elevado en hardware y licencias.

Esta situación llevó a que surgieran iniciativas como Spring que ofrecían la misma idea de estandarización pero sustentada en contenedores web ligeros, gratuita y sustentada en una gran comunidad de desarrolladores.

Proyectos como Spring sirvieron para que, primero Sun y ahora Oracle, entendiesen que el desarrollo debía evolucionar hacía una concepción más sencilla donde el desarrollo fuese lo más cercano posible a la escritura de POJO’s y los servidores de aplicaciones mucho más ligeros y optimizados. Y por qué no decirlo, se consiguió aceptando como estándar las mejores ideas de los competidores. Esto se consigue sobre todo a partir de la madurez en el mercado de Java EE 6.

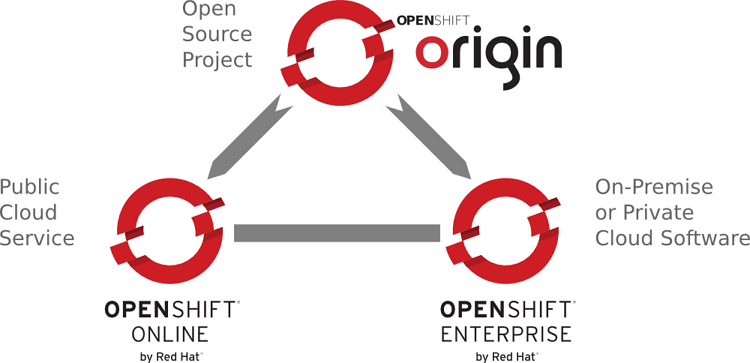

1.3. Introducción a WildFly

WildFly es el nuevo nombre que recibe el servidor de aplicaciones JBoss, desarrollado por Red Hat. Frente a las versiones anteriores (JBoss AS 7.1 y EAP6) presenta las siguientes novedades:

-

Compatible y optimizado para la JVM de Java SE 7. Esto se traduce en mejoras de rendimiento en Entrada/Salida, políticas de Garbage collector y concurrencia.

-

Certificado para Java EE 7 Web y Full Profile.

-

Roles definidos dentro de los usuarios administradores. Se puede delimitar con mayor detalle las tareas que puede realizar un usuario administrador.

-

Nuevo Servidor Web. Tradicionalmente se utilizaba Tomcat, pero en esta versión se sustituye por Undertow, que proporciona un mayor rendimiento.

-

Mejoras en las herramientas de administración (Consola, línea de comandos).

-

Reducción del número de puertos de escucha a solo 2, puerto de trabajo y puerto de administración.

Si bien es interesante académicamente poder trabajar con la última especificación de Java EE, Red Hat no ofrece ninguna variante con soporte comercial, por tanto en el mundo de la empresa es más recomendable continuar con una versión anterior ya sea comercial u Open Source.

1.3.1. Instalación de WildFly

La instalación del servidor es muy sencilla. Basta con conectarse a http://www.wildfly.org y descargarse un fichero ZIP. Es recomendable establecer la variable de entorno JBOSS_HOME apuntando a la carpeta donde se vaya a descomprimir el servidor:

export JBOSS_HOME=/usr/share/wildfly-8.2.11.3.2. Definición de dominio

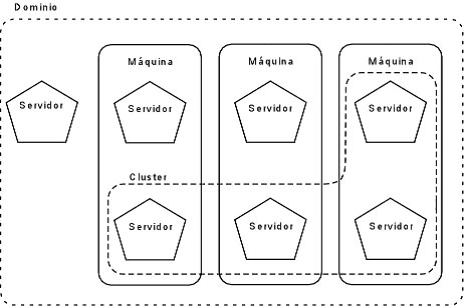

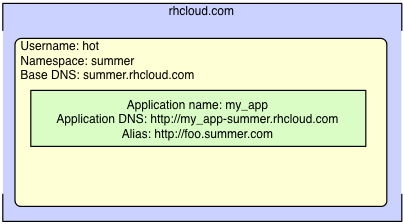

Un dominio define un conjunto de propiedades, recursos e instancias de servidores de aplicaciones. La definición de dominios permite flexibilizar y organizar la instalación de servidores de aplicaciones, ya que es posible asignar distintos dominios dentro de un mismo host a distintas organizaciones y administradores. Las aplicaciones y recursos instaladas en un dominio son independientes de los otros dominios. Para permitir que distintos dominios puedan estar en marcha al mismo tiempo, cada dominio utiliza distintos puertos de servicio y administración.

1.3.3. Modos de trabajo de WildFly

Standalone

Es el modo más sencillo y habitual. Permite ejecutar WildFly como un proceso independiente. Este modo de trabajo no es incompatible con una configuración HA, por lo que podemos tener configurados varios servidores independientes en clúster. Para iniciar WildFly en modo Standalone hay que ejecutar el script:

standalone.shManaged Domain

En este modo se permite iniciar uno o varios servidores de WildFly administrados de forma conjunta desde un único dominio. La forma de iniciar un dominio WildFly es a través del script:

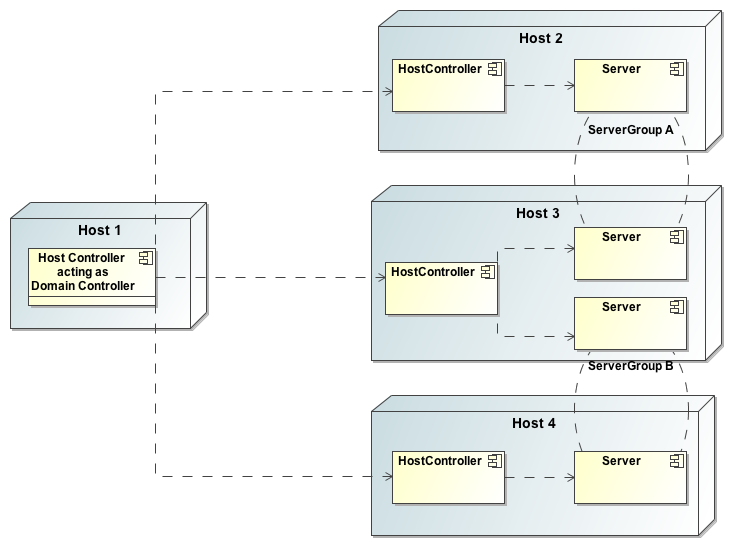

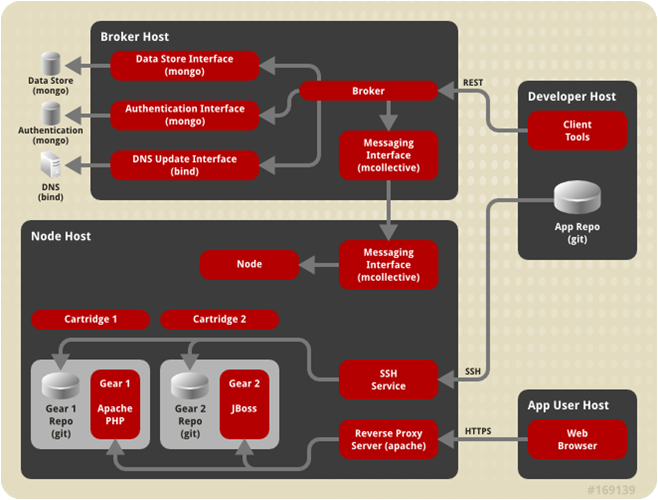

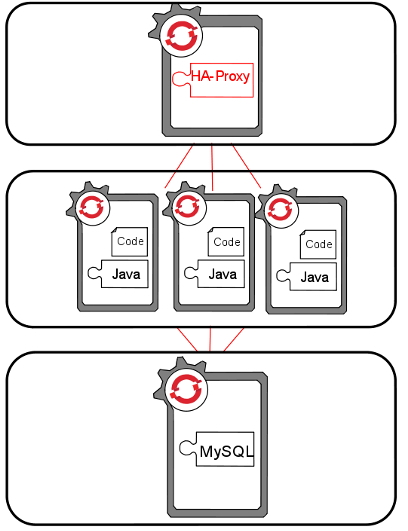

domain.shEste script iniciará un proceso denominado Host Controller, que se encargará de iniciar los servidores administrados del dominio. El siguiente diagrama describe un dominio WildFly:

Los conceptos de host y servidor ya los conocemos, pero tenemos nuevos elementos:

- Host Controller

-

Al ejecutar el script domain.sh, se inicia un proceso denominado Host Controller cuya única misión es la de iniciar/parar los distintos servidores que se hayan definido en la máquina. Para ello se comunica con el proceso Domain Controller que definiremos a continuación.

- Domain Controller

-

Dentro de un dominio debe existir un proceso Host Controller configurado como el Domain Controller, es decir como almacén central de la configuración del dominio. Este proceso será el encargado de gestionar las políticas de administración, de sincronizar dichas políticas con el resto de Host Controllers del dominio

- Server Group

-

Un server group es un conjunto de instancias que deben ser administradas como si fueran una sola. En una configuración de dominio puede haber uno o varios grupos, y cada servidor de aplicaciones debe ser miembro de un grupo, aún en el caso de que sólo exista un servidor en el dominio. Es responsabilidad del Domain Controller y de los Host Controllers que todos los servidores dentro de un grupo tengan una configuración coherente y los mismos despliegues.

1.3.4. Estructura de directorios de WildFly

Las carpetas más importantes:

-

appclient: contiene ficheros de configuración y propios del contenedor de aplicaciones clientes.

-

bin: contiene varios ficheros de configuración de arranque, jboss-client.jar para acceder crear una aplicación cliente Java.

-

domain: Contiene los ficheros de configuración del modo Managed Domain y datos de ejecución del servidor en este modo.

-

standalone: Similar la anterior, pero específica del modo Standalone.

-

welcome-content: Contenido estático de la aplicación web por defecto.

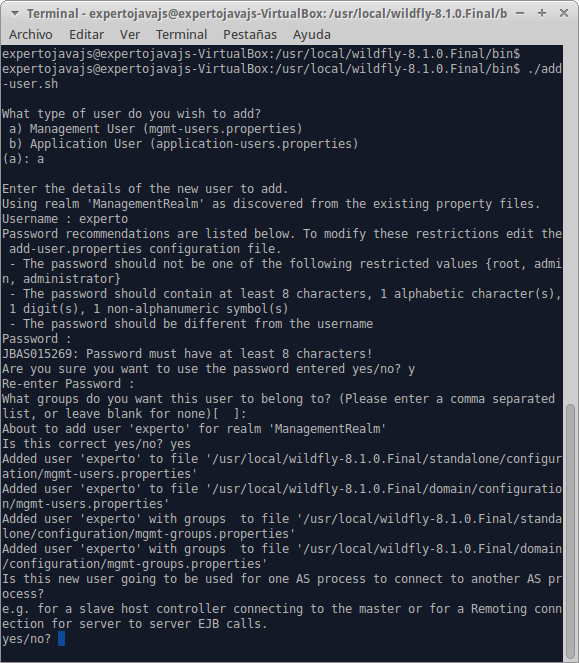

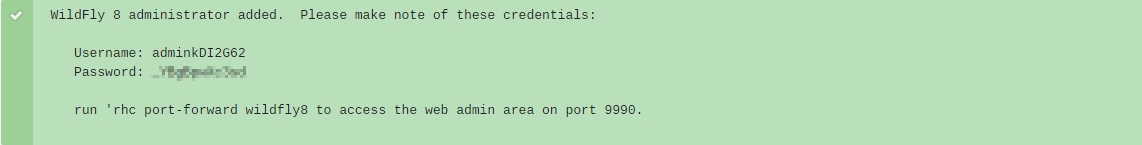

1.3.5. Creación de un usuario administrador

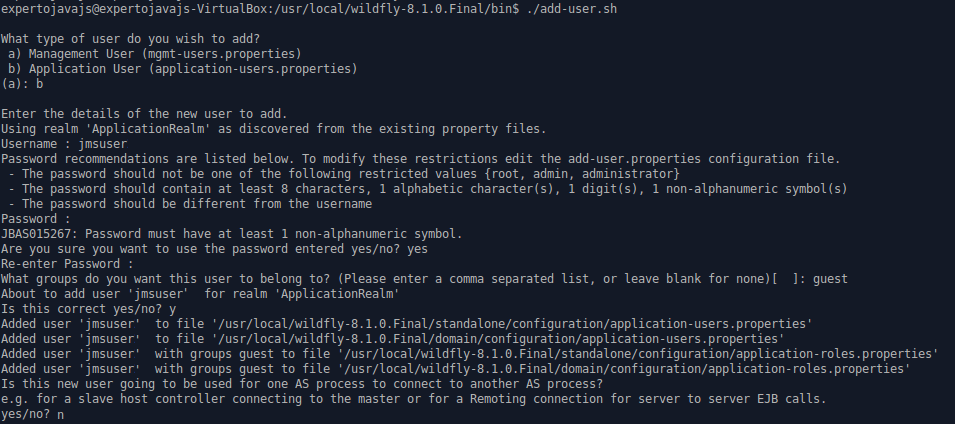

Para poder comenzar a trabajar con WildFly es necesario crear un usuario administrador y para ello utilizaremos el script add-user.sh.

En este ejemplo, hemos creado el usuario experto como usuario administrador perteneciente al ManagementRealm. Es importante contestar SI a la última pregunta para indicar que el usuario se podrá conectar al domain controller. Se generará una password encriptada que se utilizará a la hora de configurar un dominio de servidores de aplicaciones.

1.4. Herramientas de administración de WildFly

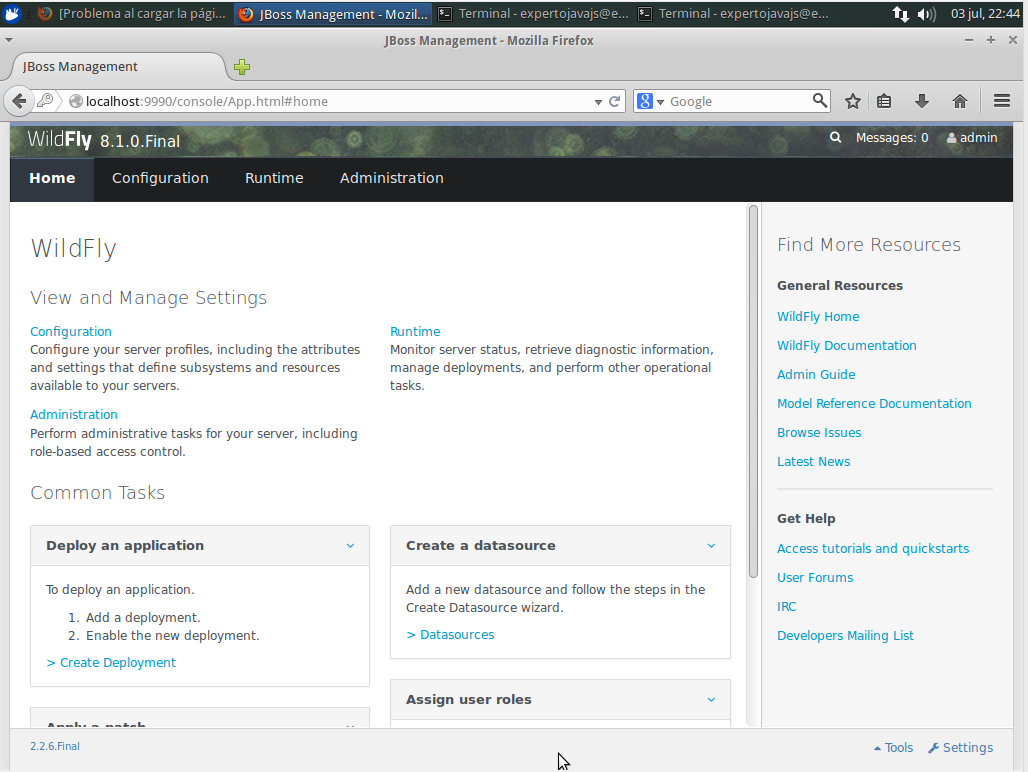

1.4.1. Consola de administración Web

Mediante la consola de administración podemos acometer las tareas más básicas de una forma amigable. El puerto de administración habitual es el 9990, y para acceder a la consola basta con abrir la dirección:

Comparada con la consola de administración de otros servidores como WebLogic o incluso GlassFish es mas rudimentaria, si bien ha mejorado notablemente con respecto a versiones anteriores.

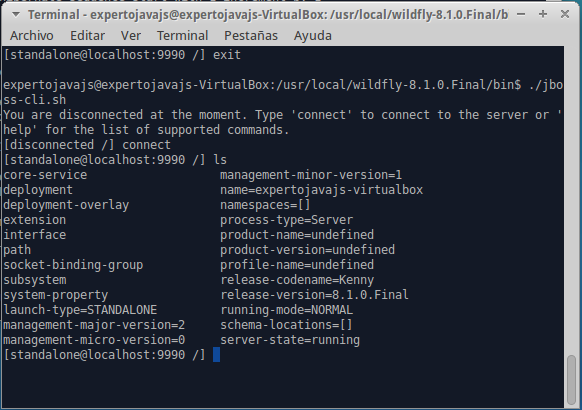

1.4.2. Command Line Interface (CLI)

Se trata de una herramienta de administración desde una pantalla de terminal. A esta consola se accede ejecutando el script jboss-cli.sh

Desde esta consola se puede cambiar la configuración de un servidor local o remoto. Parámetros más importantes:

$ ./jboss-cli.sh [--help] [--version] [--connect] [--controller] [--commands] [--user] [--password] [--file]- --help

-

Muestra un listado de comandos admitidos

- --version

-

Muestra información de la versión de WildFly y de la máquina.

- --connect

-

Comando utilizado para conectarnos al servidor e iniciar su administración

- --controller

-

Host:puerto al que nos queremos conectar

- --commands

-

Permite especificar una o varias instrucciones de administración.

- --user/password

-

Credenciales para conectarse a un servidor, utilizadas normalmente al acceder a un servidor remoto.

- --file

-

Permite ejecutar un script con múltiples instrucciones de administración.

Ejemplos de uso:

#Conexión a un servidor local (localhost:9990)

./jboss-cli.sh --connect

#Conexión a un host controller remoto

./jboss-cli.sh --connect --controller=192.168.10.1 --user=admin1234 --pasword=pass1234

#Ejecutar una secuencia de comandos

./jboss-cli.sh --commands="connect,deploy prueba.jar"

#Ejecutar un script de administración

./jboss-cli.sh --file=myscript.cli

#Parar el servidor

./jboss-cli.sh --connect --command=shutdownEjemplo de script:

# Connect to Wildfly instance

connect

# Create Spring Batch Module

module add \

--name=org.springframework.batch \

--dependencies=javax.api,javaee.api \

--resources=${wildfly.module.classpath}En el caso de que tengamos algún problema con la configuración, que no permita operar normalmente al servidor, podemos recurrir al siguiente comando:

./standalone.sh --admin-onlyEste comando permite arrancar el servidor en modo administración, bloqueado excepto para tareas administrativas. De esta forma podremos acceder a CLI y corregir la configuración. Una vez hecho esto, podemos salir del modo administración con el siguiente comando:

[standalone@localhost:9990/]reload --admin-only=falseUna vez estemos conectados a una instancia de WildFly podemos trabajar directamente sobre la configuración del servidor como si fuera un sistema de ficheros:

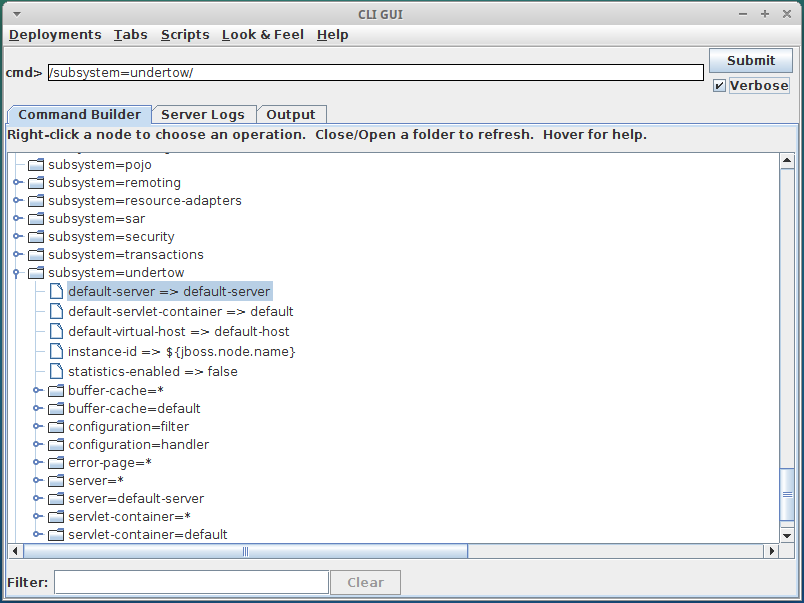

Por último, si queremos una interfaz más amigable, podemos ejecutar la consola en modo gráfico:

./jboss-cli.sh --gui

1.4.3. Edición manual de los ficheros de configuración

Toda la configuración del servidor persiste en ficheros XML que se pueden editar manualmente. En la siguiente sesión veremos con más detalle la forma en la que WildFly almacena esta configuración pero hay que tener en cuenta que lo recomendable hacer cambios en la configuración mediante las herramientas de administración, sobre todo en servidores de producción.

1.5. Aplicaciones Java Enterprise

1.5.1. Empaquetado de aplicaciones

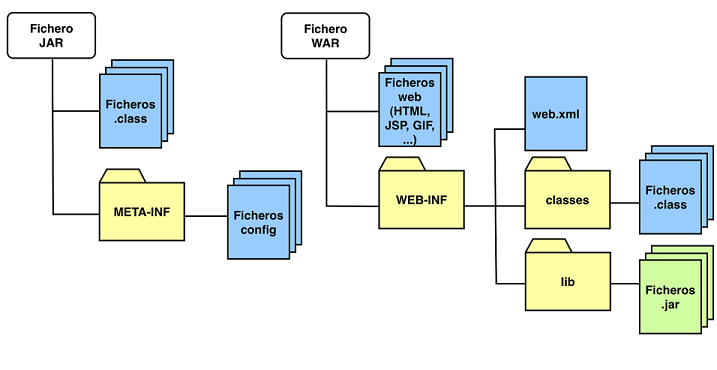

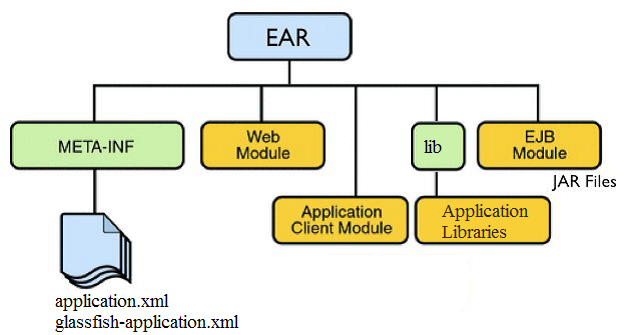

Hasta ahora hemos utilizado dos tipos de ficheros para empaquetar aplicaciones Java: ficheros JAR y ficheros WAR. Además de estos tipos hay un tercero específico de las aplicaciones Java Enterprise: el EAR.

Los ficheros JAR empaquetan clases Java. Un fichero JAR contiene clases Java compiladas (ficheros .class) junto con un descriptor de la aplicación.

Cuando un fichero JAR se añade al classpath de una JVM (Máquina Virtual Java) las clases incluidas en él se ponen a disposición de cualquier aplicación Java que ejecute la JVM. De la misma forma, cuando un fichero JAR se define en el classpath del compilador Java, las clases incluidas en él pueden utilizarse en las clases que estamos compilando.

Una idea fundamental relacionada con el empaquetado de clases es que el compilador Java y la máquina virtual Java tienen distintos classpath, esto es, resuelven las dependencias utilizando distintos ficheros. Esto trasladado a una aplicación Java Enterprise permite que para compilar una aplicación estándar, únicamente necesitemos una dependencia:

<dependencies>

<dependency>

<groupId>javax</groupId>

<artifactId>javaee-api</artifactId>

<version>7.0</version>

<scope>provided</scope>

</dependency>

</dependencies>El servidor de aplicaciones por su parte contendrá tanto la especificación como las librerías (jars) específicas que implementen la especificación.

Las aplicaciones web empaquetadas en ficheros WAR son más complejas puesto que pueden contener recursos estáticos, clases compiladas y librerías Jar. Al desplegar una aplicación web en un servidor de aplicaciones, las librerías contenidas pasan a formar parte del classpath de la aplicación exclusivamente.

¿Qué ocurre si queremos utilizar una misma librería en distintas aplicaciones Web desplegadas en un servidor? Si las incluimos en cada aplicación y son pesadas, penalizará el arranque del servidor y elevará el consumo de recursos innecesariamente. Para evitarlo tenemos varias formas:

-

Incluir la librería directamente en el classpath del servidor (¡No recomendado!)

-

Despliegue del jar como librería compartida, en el caso concreto de WildFly sería declararla como módulo global del servidor en ficheros de configuración.

-

Si son aplicaciones relacionadas empaquetarlas dentro de un fichero EAR.

Los ficheros EAR representan una aplicación empresarial formada por distintos módulos (aplicaciones web y ficheros JAR). Los ficheros JAR pueden ser librerías o Enterprise JavaBeans (EJB) usados por las aplicaciones web y estarán disponibles para cualquier aplicación contenida.

Otra característica de los EAR es que permite el control unificado (arranque, despliegue, parada…) del conjunto de las aplicaciones contenidas.

Físicamente, un fichero EAR es un fichero comprimido con el mismo formato que los ficheros JAR. Todos los comandos que se pueden utilizar con los ficheros JAR (jar -tvf mi-fichero.jar, etc.) sirven para los ficheros EAR. Los ficheros EAR llevan la extensión .ear. La estructura de un fichero EAR es sencilla, contiene un conjunto de ficheros WAR, un conjunto de ficheros JAR y el directorio META-INF, en el que se encuentra los distintos ficheros de configuración necesarios. Opcionalmente puede contener el descriptor de despliegue application.xml en el que se identifican los módulos que se incluyen en él.

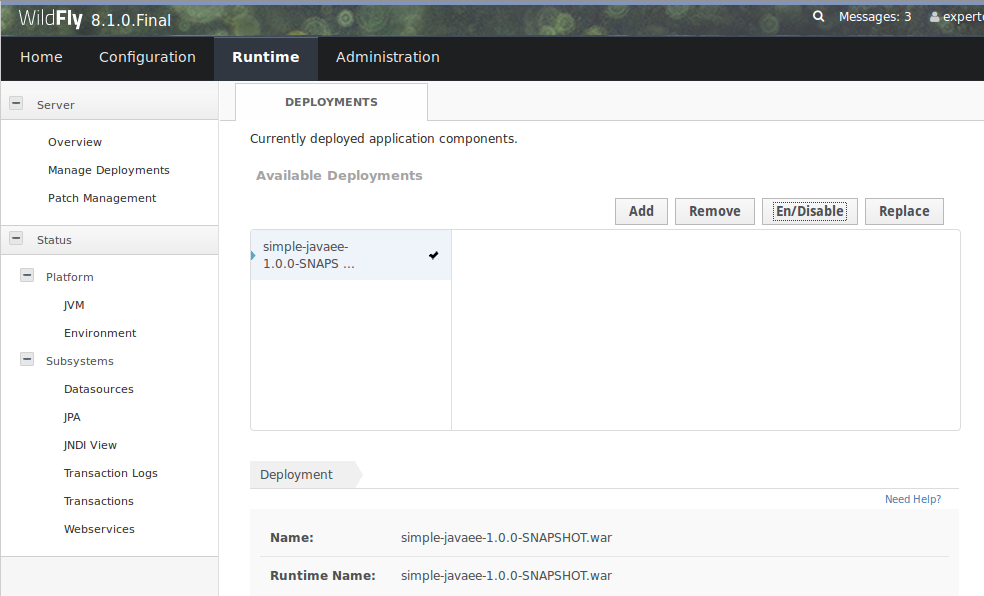

1.5.2. Despliegue de aplicaciones en WildFly

WildFly nos ofrece tres posibilidades:

-

Despliegue desde sistema de ficheros (sólo en modalidad standalone).

cp example.war /usr/local/wildfly-8.2.1.Final/standalone/deploymentsWildFly distingue entre aplicaciones empaquetadas (Jar,War,Ear) o aplicaciones descomprimidas (exploded). Por defecto el autodeploy está habilitado para las aplicaciones empaquetadas pero no para las exploded. En el caso de que el despliegue sea manual, se controla mediante ficheros auxiliares llamados markers. Estos ficheros ficheros también aparecen cuando falla un despliegue por autodeploy (fichero application.FAILED). Si lo eliminamos, el escáner intentará deplegar la aplicación de nuevo.

La configuración del escáner de despliegues se realiza sobre el fichero standalone.xml o a través de CLI:

<deployment-scanner scan-interval="5000" relative-to="jboss.server.base.dir"

path="deployments" auto-deploy-zipped="true" auto-deploy-exploded="false"/>Para más detalles podéis consultar la documentación de WildFly: https://docs.jboss.org/author/display/WFLY8/Application+deployment

-

Mediante las herramientas de administración

[standalone@localhost:9990/]deploy example.war

-

Uso de herramientas de terceros como por ejemplo wildfly-maven-plugin

<plugin>

<groupId>org.wildfly.plugins</groupId>

<artifactId>wildfly-maven-plugin</artifactId>

<version>1.0.2.Final</version>

<executions>

<execution>

<phase>install</phase>

<goals>

<goal>deploy</goal>

</goals>

</execution>

</executions>

</plugin> [standalone@localhost:9990/]mvn wildfly:deploy

[standalone@localhost:9990/]mvn wildfly:redeploy

[standalone@localhost:9990/]mvn wildfly:undeploy|

Ejecutar aplicacion sin instalación previa de WildFly wildfly:run

Es una función interesente del plugin de maven de cara a realizar pruebas o ejecutar la aplicación en una máquina donde no tenemos configurada ninguna instancia de WildFly. Este comando Maven descarga automáticamente un servidor WildFly en modo standalone y despliega en el la aplicación compilada.

|

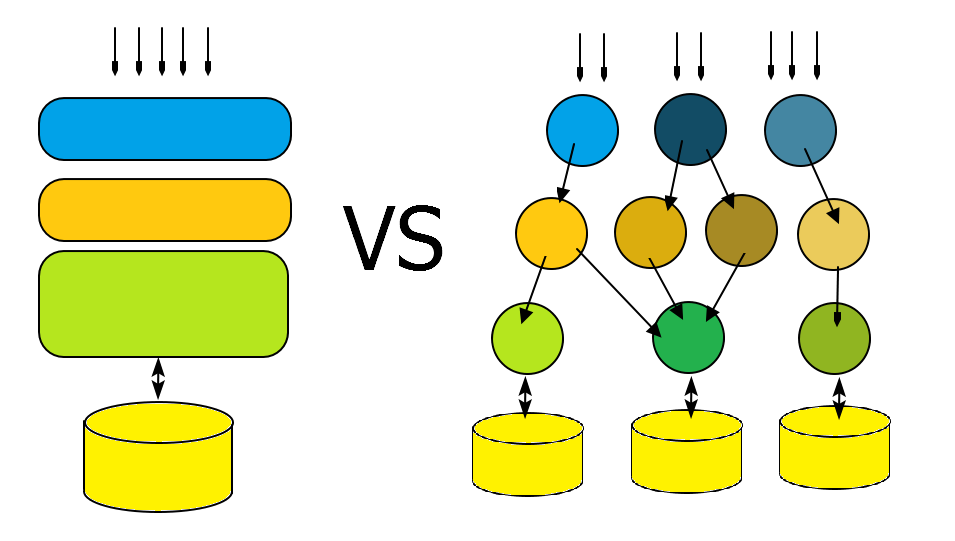

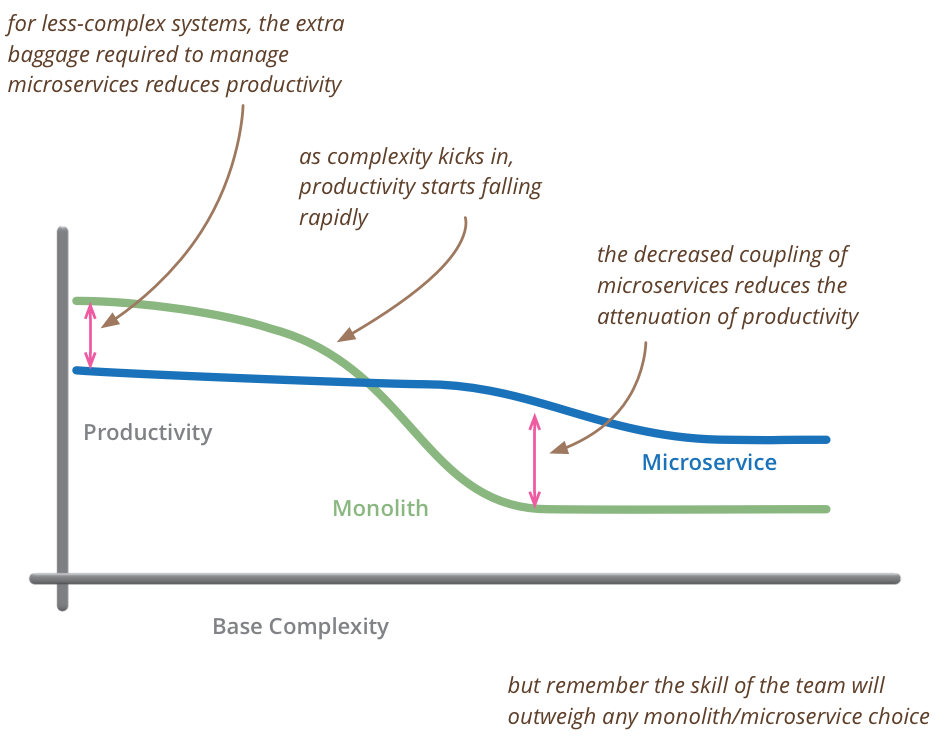

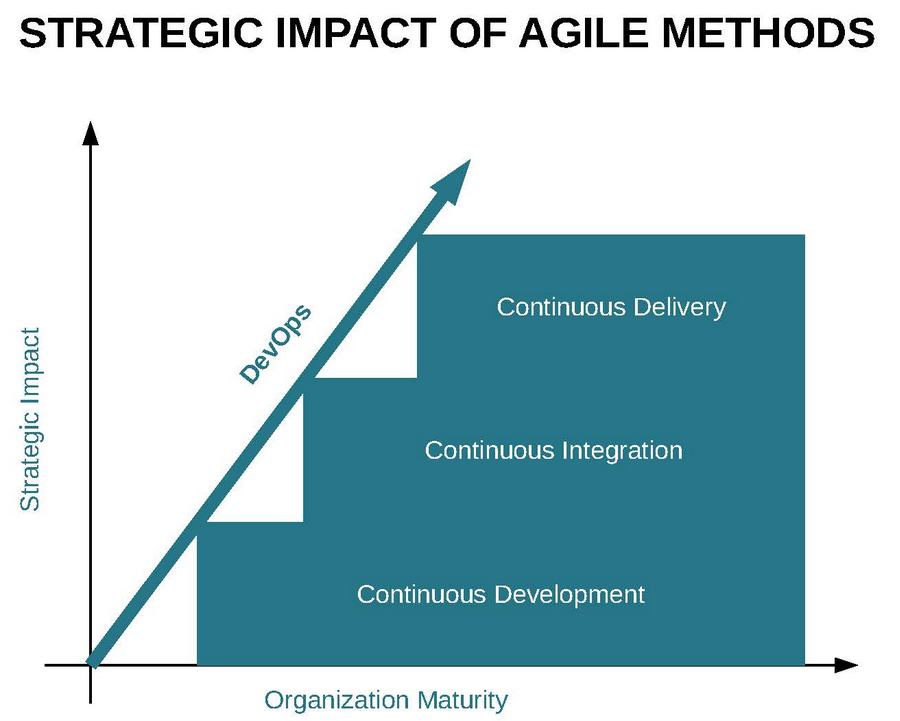

1.6. Arquitecturas basadas en microservicios

Una arquitectura basada en microservicios es una forma de entender las aplicaciones como un conjunto de pequeños servicios, cada uno ejecutándose como proceso independiente y comunicándose con el resto mediante mecanismos sencillos y "agnósticos", a menudo HTTP. Estos servicios se diseñan sobre funciones de negocio y siguen estrategias de de despliegue independientes. Aunque se trate de servicios independientes suele existir una pequeña lógica de administración común para estos servicios, que pueden estar construidos usando distintos lenguajes de programación y diferentes tecnologías de almacenamiento.

Martin Fowler (padre del término microservicio)

Este tipo de arquitectura nace en contraposición a las grandes aplicaciones Monolíticas. En el mundo Java, una aplicación monolítica podría ser un EAR con una serie de módulos y librerías dependientes que se gestiona como una unidad. En si mismo ésto no tiene porqué ser un problema (sigue siendo un modelo válido) hasta que la propia envergadura del proyecto o la dificultad para alcanzar requerimientos de escalabilidad o separación de responsabilidades evidencíen dificultades de gestión. En cierta medida microservicios trata más de organización del trabajo que de tecnologías concretas.

También hay que destacar que el término de "micro" no se refiere al tamaño del servicio si no a la funcionalidad que desempeña. Para definir correctamente un microservicio hay que apoyarse en buenas prácticas de programación ya establecidas como la alta cohesión y bajo acoplamiento o el Principio de Responsabilidad Única (Un subsistema, módulo o incluso clase sólo debe tener un motivo para cambiar).

Se podría entender como un SOA 2.0 (Arquitectura Orientada a Servicios) o un SOA pragmático donde se sustituyen protocolos pesados como SOAP y elementos como ESB’s donde se ejecutaba gran cantidad de lógica por servicios donde la inteligencia está en el propio servicio y no existe un control y persistencia centralizados.

1.6.1. Ventajas de una arquitectura basada en Microservicios sobre una monolítica

- Facilidad para escalar el desarrollo

-

Permite dividir el trabajo entre equipos de trabajo reducidos, con conocimientos completos del stack de desarrollo y con una responsabilidad funcional acotada. (Two Pizza teams)

- Aislamiento ante fallos

-

Si un servicio tiene un fallo, es factible corregir dicho servicio y desplegarlo individualmente sin afectar al resto de la aplicación.

- Despliegues más rápidos

-

Poder desplegar por partes facilita el poder realizar despliegues a producción más frecuentes y con un riesgo menor.

- Elimina la dependencia a largo plazo de una tecnología

-

El utilizar mecanismo de comunicación agnósticos, permite que podamos utilizar la tecnología más adecuada para cada servicio, en contraposición al modelo de EAR donde se elige un único "stack" para toda la aplicación. Si en un momento decidimos cambiar de tecnología, podemos ir reemplazando paulatinamente los servicios afectados.

1.6.2. Desventajas

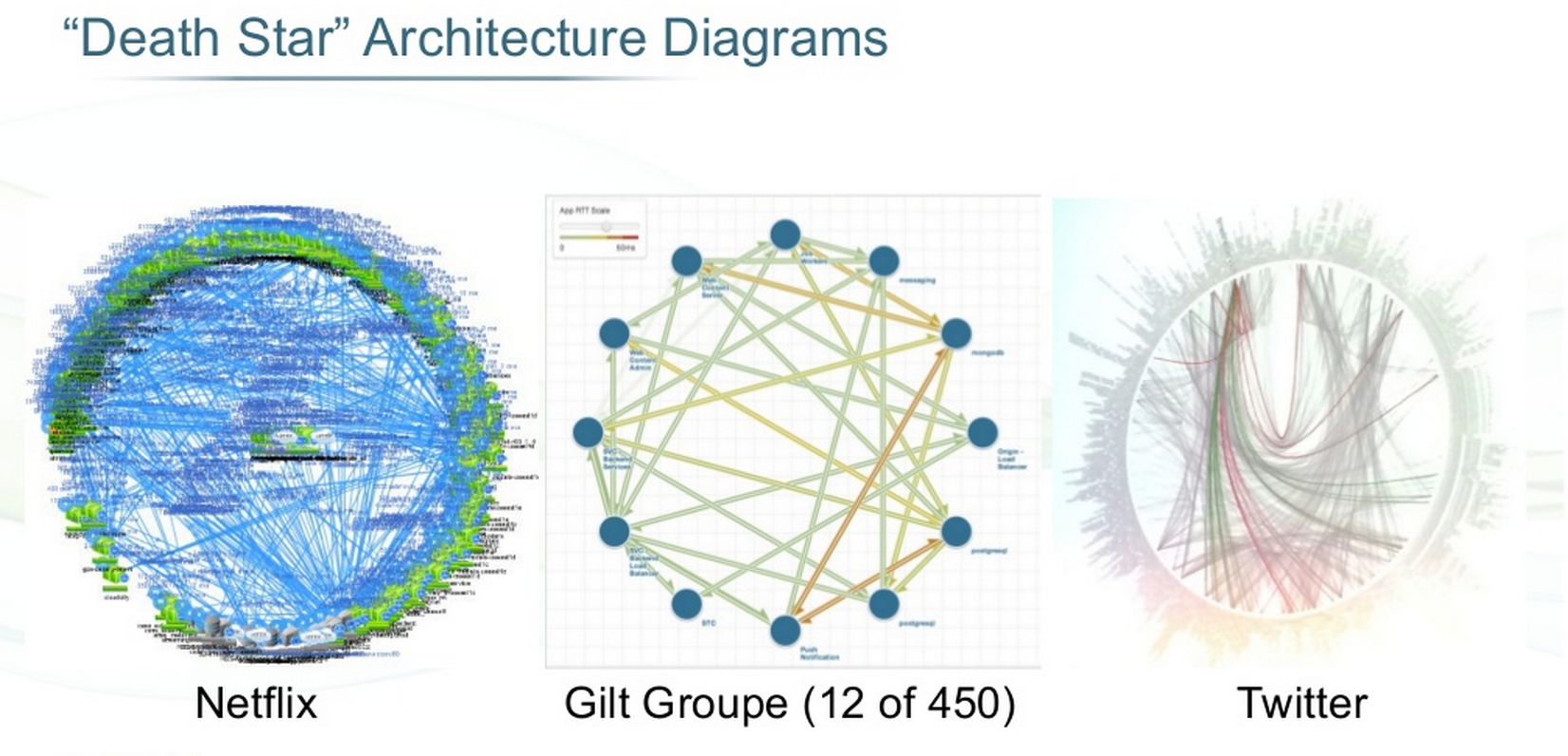

- Complejidad de un sistema distribuido

-

Servicios independientes requieren una monitorización independiente, recursos de ejecución adicionales, herramientas de descubrimiento, gestión de logs… en definitiva costes y complejidad adicionales a las de un proyecto monolítico.

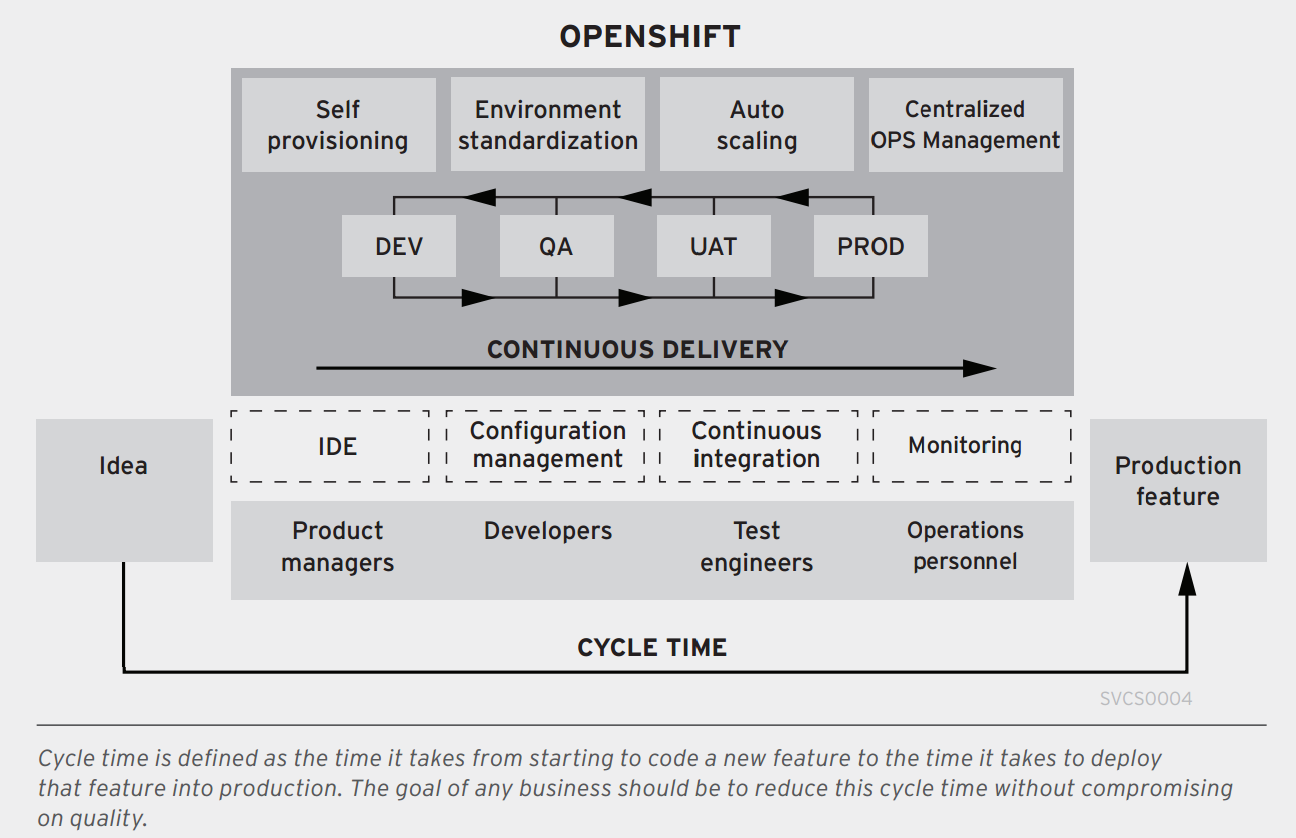

- Requieren cultura DevOps

-

Las iniciativas DevOps permiten automatizar los procesos de validación y despliegue de los nuevos servicios y allanar las dificultades anteriores. Comentaremos con más detalle qué es DevOps en sesiones posteriores.

- Falta de herramientas

-

Las herramientas tradicionales están orientados a desarrollos monolíticos y no tanto a proyectos complejos distribuidos.

- Comunicación y coordinación entre equipos

-

Si bien gestionar un equipo grande es complejo, el coordinar y compartir conocimiento entre equipos independientes también plantea retos.

1.6.3. Cuándo utilizar microservicios

Según Martin Fowler no se debería considerar una arquitectura basada en microservicios hasta tener un sistema monolítico que sea demasiado complejo de mantener. Nosotros añadiríamos otro motivo: cuando las necesidades de escalabilidad del trabajo lo justifiquen o se necesite utilizar distintas tecnologías en distintas funciones de negocio.

Para un desarrollo ya existente, un enfoque muy aceptado es asegurar en primer lugar una que tenemos una aplicación monolítica correcta en términos de arquitectura:

-

Separación de funciones.

-

Alta cohesión y bajo acoplamiento utilizando APIs bien definidas.

-

Sin redundancias.

-

Diseño dirigido por el Dominio (DDD).

-

Lo demás "sobra".

De forma progresiva, se puede ir identificando las distintas funciones de negocio y separarlas en serivicios siguiendo el principio de responsabilidad única (SPR). Una vez definidos los servicios más básicos, las aplicaciones harán uso de ellos combinándolos según diferentes patrones (Ver referencias).

Una vez definidos los servicios básicos las aplicaciones harán uso de ellos combinándolos siguiendo distintos patrones:

1.6.4. Java EE Y los microservicios

El estado de evolución actual de la especificación Java EE permite afrontar el desarrollo de aplicaciones basados en nuevas arquitecturas. Hoy en día, es razonable utilizar un servidor de aplicaciones para desplegar un único servicio basado en Java EE sin incurrir en un consumo excesivo de recursos y beneficiándonos de años de estandarización y una amplia gama de servicios.

En cifras, usar un servidor de aplicaciones completo hoy en día puede suponer un sobrecoste de unos 30-50Mb de RAM sobre una aplicación java standalone , así como unos 100Mb de espacio en disco y el tiempo de arranque puede ser de 1-3 segundos de tiempo. En una aplicación empresarial con un número de servicios limitado esto no supone un problema. De hecho, resulta curioso ver cómo se ha ido reduciendo el consumo de recursos en la parte servidora y sin embargo hemos sobrepasado el consumo de las aplicaciones de escritorio pesadas en el lado del cliente (Vease Chrome, por ejemplo).

Sólo en el caso de aplicaciones altamente escalables y orientadas a internet (al nivel de Google, Netflix, etc.), merece la pena invertir esfuerzos en reducir al máximo las librerías necesarias para que un servicio funcione. Aún así puede ser más ventajoso aprovechar la modularidad de los servidores de aplicaciones que construir una solución desde cero.

Hay ponentes como Adam Bien que plantean un modelo minimalista de aplicación Java EE con las siguientes características:

- 1 servidor de aplicaciones, 1 dominio y 1 WAR

-

El concepto de servicio quedaría constituido por un servidor de aplicaciones que ofrezca todo el API Java EE (Full Profile) a una aplicación desplegada como WAR que implemente un servicio.

- WARs ligeras

-

El tamaño de un fichero WAR y su complejidad interna influye negativamente en los tiempos de despliegue y arranque de una aplicación. Para conseguir mejores resultados Adam Bien propone los siguientes cambios sobre el modelo de desarrollo de aplicaciones Web:

-

Utilizar preferentemente las librerías que proporciona el servidor de aplicaciones, en lugar de incluirlas en la aplicación. Esto ya puede suponer pasar de trabajar con un fichero de varios megabytes a unos pocos Kilobytes.

-

Aplicaciones Autocontenidas: toda la lógica del servicio debe estar incluida dentro del War.

-

Reducir o eliminar los módulos JAR internos. Ya hemos comentado que es habitual trabajar con aplicaciones WAR que contienen a su vez librerías JAR con clases diversas y EJB’s. Este esquema ralentiza las compilaciones y despliegues y en realidad la aplicación siempre se compila o despliega como un todo, por lo que la división interna en librerías no aporta ventajas en muchos casos.

-

- Estructura del código

-

-

No utilizar interfaces. Únicamente los utilizaremos cuando sepamos que vamos a tener diferentes implementaciones para una misma funcionalidad, pero hasta entonces no complicar el código innecesariamente.

-

Centrarnos en el código de negocio. Java EE permite que las aplicaciones estén compuestas básicamente por POJOS y permite abstraer la complejidad de los servicios. El trabajar con objetos pojo tiene el beneficio adicional de facilitar las pruebas unitarias

-

Pocas anotaciones (Convención sobre declaración): Evitar declarar propiedades que ya tengan el mismo valor por defecto dentro de su especificación.

-

Ejemplo de microservicio minimalista:

@Path("cursos")

public class CursosResource {

@GET

@Produces("application/json")

public JsonObject all(){

return Json.createObjectBuilder().add("cursos","JavaEE, JavaScript, MongoDB").build();

}

}1.6.5. Docker

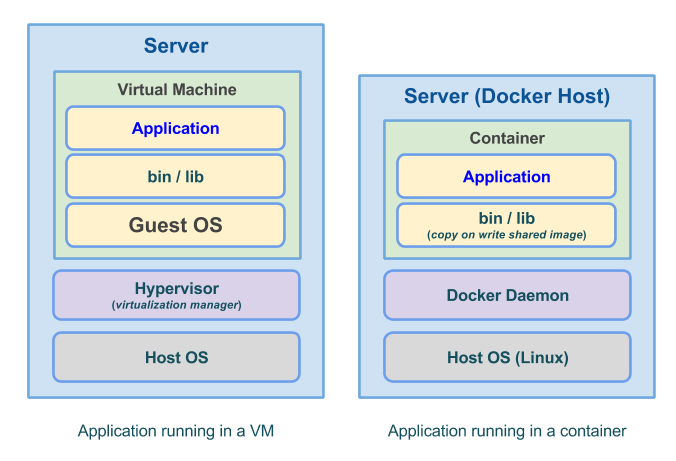

Docker ha supuesto el salto a la fama del concepto de contenerización de servicios y viene a ser una mezcla de máquina virtual con control de versiones tipo Subversion. Permite desplegar todo el stack de una aplicación o servicio en una máquina con un simple comando pull como si fuera un único paquete. Se apoya los conceptos básicos de imagen y contenedor:

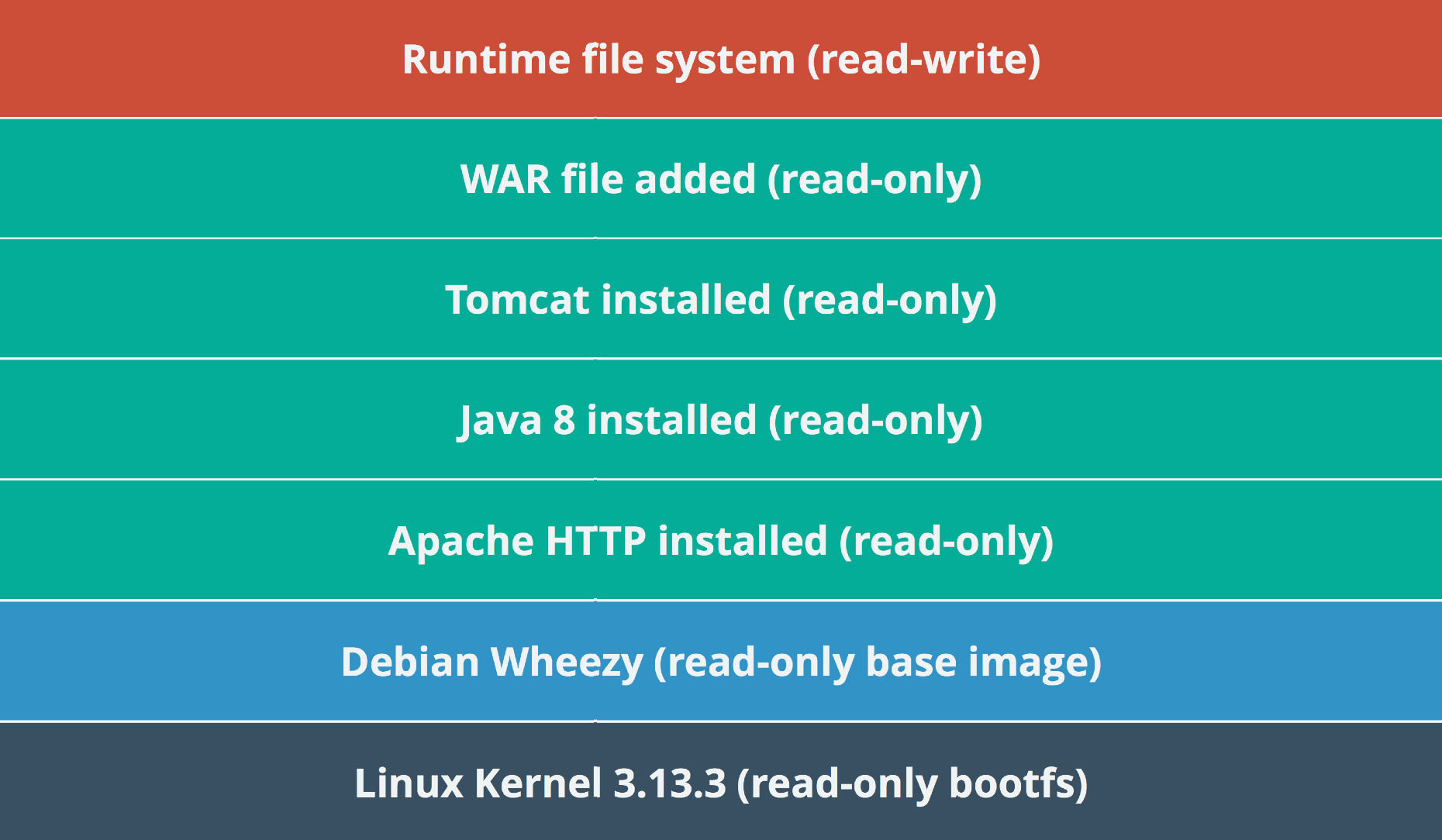

Una imagen se puede considerar como un sistema de archivos en el que podemos añadir lo que la aplicación necesite para funcionar, como una máquina virtual de Java o la instalación de un servidor de aplicaciones. Una característica fundamental es que está formado por capas, que funcionan como los commit de Git o SVN. Cada vez que se añade una capa, se superponen nuevos ficheros sobre la imagen inicial. En este caso es fundamental dejar en la última capa el despliegue de la aplicación para que cuando ésta se modifique, la imagen conserve todas sus capas y sustituya únicamente la última (que tendrá el tamaño del WAR desplegado). Aquí tenemos una importante mejor en el caso de las aplicaciones Java ligeras que proponemos, especialmente si la comparamos con las basadas en Java StandAlone (o FAT Jars).

Llamamos contenedor a la instancia en ejecución de una imagen. Apoyándose en los mecanismos de seguridad de Linux, el container se ejecuta en un espacio de memoria separado, con lo que es tarea del programador el definir la comunicación entre los procesos del container y el resto de la máquina (gestionando los puertos o montando directorios físicos fundamentalmente). Hay que tener siempre presente que cada vez que se inicia un contenedor, se parte de la imagen definida por lo que cualquier cambio que se realice sobre el sistema de ficheros propio del contenedor NO se almacenará en la imagen y por tanto se perderá.

Entender Docker es mucho más sencillo en la práctica, así que en los ejercicios veremos un pequeño ejemplo.

1.7. Referencias

-

Información sobre Roles Java EE http://docs.oracle.com/javaee/6/tutorial/doc/bnaca.html .

-

Wiki con los distintos servidores de aplicaciones y sus especificaciones http://en.wikipedia.org/wiki/Java_Platform,_Enterprise_Edition .

-

Información sobre WildFly http://wildfly.org/about/ .

-

Guia de iniciación https://docs.jboss.org/author/display/WFLY8/Getting+Started+Guide .

-

Guía completa de administración https://docs.jboss.org/author/display/WFLY8/Admin+Guide#AdminGuide-Examplesinthisguide .

-

Despliegues desde sistema de ficheros https://docs.jboss.org/author/display/WFLY8/Application+deployment

-

WildFly Maven Plugin https://docs.jboss.org/wildfly/plugins/maven/latest/index.html

-

Java EE 7 Examples https://github.com/javaee-samples/javaee7-samples

-

Spring Boot http://projects.spring.io/spring-boot/

-

Dropwizard http://www.dropwizard.io/

-

WildFly Swarm http://wildfly.org/swarm/

-

WAS Liberty https://developer.ibm.com/wasdev/

-

Desarrollo con WildFly y Docker http://tools.jboss.org/blog/2015-03-03-docker-and-wildfly-2.html

-

Introducción a los microservicios http://microservices.io/patterns/microservices.html

-

Patrones de diseño para microservicios http://blog.arungupta.me/microservice-design-patterns/

-

Docker https://www.docker.com/

-

Simulador online de Docker http://dockersim.com/

-

Docker Maven plugin https://github.com/spotify/docker-maven-plugin/tree/master

-

ECB Model http://www.cs.sjsu.edu/~pearce/modules/patterns/enterprise/ecb/ecb.htm

1.8. Ejercicios de Introducción a los servidores de aplicaciones y a WildFly

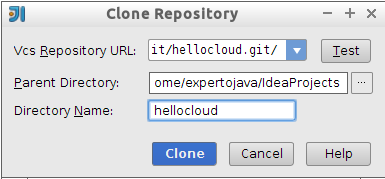

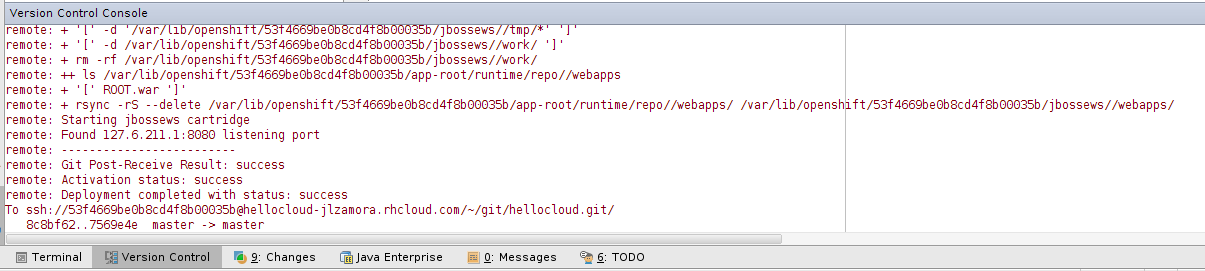

Al ser los primero ejercicios del módulo de PaaS debéis hacer un fork del repositorio ejercicios_paas. En el debéis almacenar todos los ejercicios del módulo Servidores Web y PaaS independientemente de que luego en IntelliJ se gestionen en proyectos separados. De hecho, en las sesiones OpenShift trabajaremos con repositorios Git independientes por aplicación.

Además de este repositorio, tenéis los ejemplos de cada sesión dentro de la carpeta ejemplos del mismo repositorio, por si queréis probarlos con más detalle.

1.8.1. Desarrollo de un microservicio (0.3 Puntos)

Partiendo de que ya habéis trabajado con WildFly en sesiones anteriores vamos a centrarnos en el desarrollo de una aplicación Java EE, de nombre cursos, que sirva para practicar los distintos tipos de despliegue que admite el servidor tanto como instalación local como virtualizada a partir de una imagen de Docker.

Para crear el proyecto utilizaremos Maven y un arquetipo elaborado por Adam Bien, que ofrece una aplicación web similar al arquetipo estándar webapp-javaee7 pero con una única dependencia que permite referenciar todo el API de Java EE. Básicamente es un proyecto web minimalista con todo lo necesario para desarrollar.

| GroupID | Artefacto | Versión |

|---|---|---|

com.airhacks |

javaee7-essentials-archetype |

1.3 |

Pasos a seguir

1.- Crearemos un nuevo módulo Maven dentro del proyecto de ejercicios a partir de este arquetipo y lo denominaremos cursos. Las propiedades completas del nuevo artefacto serán:

| GroupID | Artefacto | Versión |

|---|---|---|

org.expertojava.paas |

cursos |

1.0 |

Por último indicaremos que el nuevo módulo dentro de IntelliJ se llamará cursos así como el directorio dentro del proyecto principal.

2.- Renombraremos el paquete com.airhacks del proyecto generado a es.ua.expertojava.paas.cursos mediante la herramienta Refactor de IntelliJ. Tambien eliminaremos el paquete com que queda vacío tras el proceso anterior.

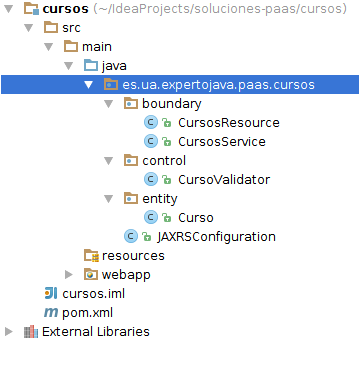

3.- Dentro del repositorio de ejercicios hay una carpeta sesion1 con subcarpetas de nombre: boundary, control y entity. Debéis copiar las tres carpetas a dentro de la carpeta es/ua/expertojava/paas/cursos/ del proyecto. Al hacerlo IntelliJ automáticamente importará las clases Java contenidas en dichas carpetas. La estructura del proyecto debe quedar de la siguiente forma:

Lo que estamos haciendo es dividir una funcion de negocio "cursos" en tres paquetes distintos con diferentes cometidoas:

- Boundary

-

Contiene las clases que definen la interfaz entre la función de negocio y el exterior.

- Control

-

Son las clases que definen la ejecución del servicio e interactuan con las otras dos capas.

- Entity

-

Son las clases que gestionan elementos de información persistentes, de mayor o menor granularidad pero con significado propio.

Esta forma de trabajar se llama patrón Entity-Control-Boundary y es una variación del MVC orientado a servicios.

4.- Añadir la unidad de persistencia al proyecto. Para ello basta con copiar la carpeta META-INF del directorio sesion1 a la ruta /src/main/resources del proyecto.

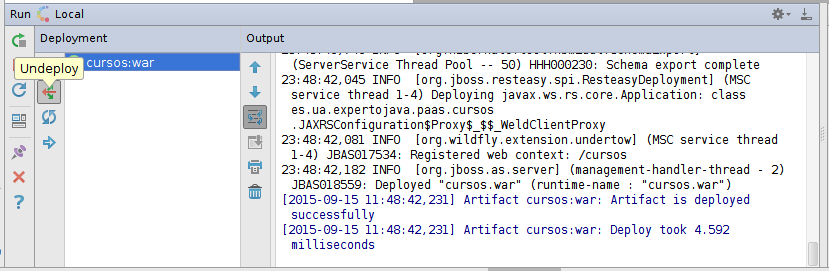

5.- Crear la configuración de despliegue en IntelliJ para poder desplegar la aplicación en nuestra instancia de WildFly.

| Si la configuración de ejecución os muestra un mensaje de error indicando que no está definida la versión del JDK a utilizar, ésta se puede establecer desde File-→ Project Structure -→ Project JDK. En nuestro caso trabajaremos con JDK 1.8. |

6.- Una vez desplegada la aplicación comprobar que funciona correctamente mediante la herramienta curl:

#Dar de alta un curso

curl -H "Content-Type: application/json" -X POST -d '{"nombre":"Curso de prueba"}' http://localhost:8080/cursos/resources/cursos

#Obtener la lista de curso almacenada

curl -X GET http://localhost:8080/cursos/resources/cursos7.- Realizar el undeploy desde IntelliJ

1.8.2. Otras formas de despliegue (0.3 Puntos)

-

Indicar en el fichero soluciones.txt, dentro de vuestro proyecto de ejercicios_paas, los pasos a seguir para realizar las siguientes tareas:

-

Desplegar la aplicación mediante Autodeploy.

-

Desplegar la aplicación mediante CLI.

-

-

Crear un script de CLI, de nombre script.cli, que liste las aplicaciones desplegadas, elimine la aplicación cursos.war y que pare el servidor.

1.8.3. Virtualización con Docker (0.6 Puntos)

|

Nota

Este ejercicio será una demostración guiada para que os familiaricéis con Docker, y sentar las bases para quien quiera profundizar más en el tema.

|

La principal diferencia entre una aplicación desplegada en una máquina virtual con respecto a Docker es que el conjunto de capas sobre las que se apoya la aplicación es más reducido:

Los contenedores se ejecutan en el espacio de memoria del Sistema operativo Host (debidamente aislados) y no requieren disponer de un sistema de archivos tan complejo como el de un sistema operativo, si no que puede apoyarse en las herramientas específicas necesarias. El resultado es que trabajamos con imágenes más pequeñas y tiempos de arranque mucho más rápidos. También hay que recordar que las imágenes están compuestas por capas apiladas por lo que un cambio en la aplicación desplegada puede suponer sustituir una sola capa, si la imagen está bien estructurada (si se tiene que modificar una capa intermedia, se reemplazan todas las capas dependientes).

La composición en capas de una imagen se define paso a paso en un fichero denominado Dockerfile. Un ejemplo:

FROM jboss/wildfly:8.2.1.Final

MAINTAINER José Luis Zamora Sánchez joseluiszamora@jlz.gmail.com

EXPOSE 8080 9990

RUN /opt/jboss/wildfly/bin/add-user.sh expertojava expertojava --silent

COPY target/cursos.war /opt/jboss/wildfly/standalone/deployments/

CMD ["/opt/jboss/wildfly/bin/standalone.sh", "-b", "0.0.0.0", "-bmanagement","0.0.0.0"]Lo primero que se indica es la capa base que vamos a utilizar, y para ello podemos utilizar una imagen que ya tengamos instalada, o bien una imagen que nos descarguemos de un repositorio. El repositorio por defecto de Docker es Docker-Hub, con un planteamiento muy similar a Git Hub. En este repositorio es donde se suelen publicar las imágenes oficiales de todos los proyectos Open Source.

También debemos indicar quien será el responsable mantener esta imagen y cómo contactar con él.

La comunicación entre el contenedor y el sistema operativo host se realiza mediante conexiones de red, de forma muy similar a otras soluciones como VirtualBox, si bien la definición se realiza en dos partes:

-

Desde el fichero Dockerfile donde se indica que puertos serán accesibles desde el exterior con el comando EXPOSE.

-

Al iniciar el contenedor donde podemos mapear puertos del Host con puertos del contenedor.

A continuación veréis una serie de comandos que realizan operaciones sobre el sistema de archivos como RUN, COPY que realmente se ejecutan en el momento de generar la imagen, no al iniciarse. Es importante indicar que cada línea del fichero Dockerfile supone una capa, por lo que si agrupamos varios comandos en una línea, físicamente se agruparán en una capa. Si os fijáis, con el comando RUN estamos definiciendo quien será el usuario administrador de la instancia de WildFly.

Esto es muy útil, por ejemplo, si copiamos un fichero ZIP con un servidor de aplicaciones, lo descomprimimos y lo eliminamos en la misma fila. Si lo hacemos así, sólo se almacenarán las diferencias, es decir la nueva carpeta descomprimida del servidor. Si lo hacemos paso a paso, tendremos una capa intermedia con el ZIP completo, que tendremos que descargar para luego eliminarlo en capas posteriores.

Por último, con el comando CMD estamos indicando qué se tiene que ejecutar por defecto al iniciar un contenedor.

Cliente docker

Para trabajar con imágenes y contenedores, necesitamos una herramienta cliente, y en nuestro caso es el comando docker. En este enlace tenéis una "chuleta" con comandos útiles para trabajar con imágenes y con contenedores:

Objetivos

Vamos a crear una imagen independiente que despliegue nuestro servicio, para ello seguiremos los siguientes pasos:

-

Abrir una cuenta gratuita en Docker Hub

La idea es que vuestra imagen quede publicada y que nosotros podamos validarla directamente a partir del repositorio, con lo que debéis acceder a la página de Docker Hub y registraros como usuarios. Posteriormente configuraréis vuestro cliente de Docker para que se conecte a Docker Hub utilizando vuestra cuenta:

expertojava@expertojava:~/IdeaProjects/cursos$ docker login Username: <vuestro usuario> Password: Email: <vuestro correo> WARNING: login credentials saved in /home/expertojava/.docker/config.json Login Succeeded -

Simular cómo se actualizaría y desplegaría un servicio en producción:

docker run -it --name=miservicio -p 8080:8080 -p 9990:9990 djbyte1977/wildfly # Para crear un nuevo contenedor docker pull djbyte1977/wildfly # Para actualizar la imagenCon estos comandos os descargaréis la última versión de la imagen wildfly de ejemplo que hemos preparado con la aplicación cursos.war ya desplegada y preparada para funcionar. También estamos mapeando los puertos 8080 y 9090 con sus equivalentes en el contenedor. El fichero Dockerfile utilizado para crear esta imagen es el que tenéis de ejemplo, por lo que si se modifica la aplicación cursos.war no tendreis que volver a descargar las capas anteriores (WildFly base + creación del usuario administrador).

El comando run -it crea un contenedo con el servidor de aplicaciones en modo interactivo, por lo que será análogo a lanzar un servidor directamente desde un CMD. Alternativamente sería posible lanzarlo en background con el comando:

docker run -d --name=miservicio -p 8080:8080 -p 9990:9990 djbyte1977/wildflyEl comando run realmente crea y ejecuta un contenedor por lo que si se ha usado previamente y se ha especificado un nombre, en la siguiente ejecución nos dará un error indicando que ya existe un contenedor con ese nombre .Una vez ya se ha asignado un nombre al contenedor se puede ejecutar simplemente:

docker start miservicio #-i modo interactivoPara enumerar los contenedores existentes tenemos el comando:

docker ps # Lista los controles en ejecución docker ps -a # Lista todos los controlesUna vez hemos lanzado un contenedor en background, lo podemos gestionar mediante los comandos de docker específicos. Ejemplo:

# Conectarse a la salida estándar del contenedor docker attach --sig-proxy=false miservicio # Parar el contenedor docker stop miservicio # Matar el contenedor vía SIGKILL docker kill miservicio -

Empaquetar el WAR cursos en una imagen Docker

Lo primero que tenéis que hacer es crear un fichero Dockerfile con los mismos pasos indicados en el ejemplo y dejarlo en la carpeta donde tengáis vuestro proyecto:

expertojava@expertojava:~/IdeaProjects/cursos$ ls cursos.iml Dockerfile pom.xml README.md src target WEB-INF expertojava@expertojava:~/IdeaProjects/cursos$Con la aplicación ya compilada, ejecutaréis el siguiente comando:

docker build -t <usuario>/wildfly .Con este comando habreis creado una nueva imagen asociada a vuestro usuario, pero que únicamente existe en el repositorio local. Si queremos compartirla, la debemos subir a Docker Hub, para ello ejecutaréis:

docker push <usuario>/wildfly -

Repetir el primer paso pero indicando la imagen que habéis creado y dándole un nombre distinto al del ejemplo. Si lo ejecutáis desde vuestra máquina no os descargaréis ninguna capa del repositorio, sin embargo si el servicio estuviera desplegado en otra máquina, al ejecutar un pull se descargaría la capa correspondiente al nuevo WAR.

|

Importante

La entrega final de este ejercicio constará del código fuente del proyecto, incluyendo el nuevo Dockerfile, y el nombre del repositorio asociado en Docker Hub para que podamos descargar y probar el servicio. El nombre del repositorio se indicará en el fichero soluciones.txt

|

1.8.4. Entrega

En esta sesión debeis entregar el código fuente del proyecto cursos, el fichero script.cli, y el fichero soluciones.txt actualizado con la información solicitada en los ejercicios.

2. Administración de recursos en WildFly

En esta sesión vamos a centrarnos en la configuración básica de una instancia de WildFly. Aunque hemos hablado de modalidades de trabajo en Dominio, vamos a centrarnos en los modos standalone por sencillez y porque no nos limitan el acceso a características de alta disponibilidad como en otros servidores.

2.1. Fichero de configuración del Bootstrap

Hay una cuestión básica que es definir cuanta memoria puede utilizar la aplicación. La forma de definir el tamaño del Heap en Wildfly es bien especificarlo como parámetro del script de arranque, o lo que es más facil, editar el fichero standalone.conf

$JBOSS_HOME/bin/standalone.conf

JAVA_OPTS="-XX:MaxPermSize=256m -Xms64m -Xmx512m"|

JDK 8

En la máquina virtual de la versión 8 desaparece el espacio de memoria denominado Permanent Generation y en su lugar se define uno nuevo denominado Metaspace. La forma de limitarlo es muy similar:

|

$JBOSS_HOME/bin/standalone.conf

JAVA_OPTS="-XX:MaxMetaspaceSize=256m -Xms64m -Xmx512m"En este fichero también podemos especificar una JVM de Java concreta, así como otras propiedades como por ejemplo el número de descriptores de ficheros que podrá utilizar WildFly

2.2. Estructura de los ficheros de configuración

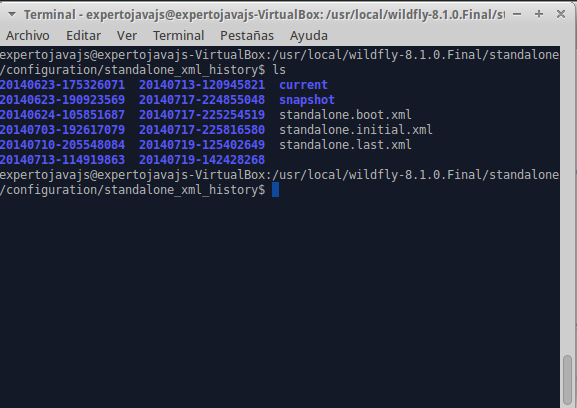

En la sesión anterior comentamos que las herramientas de administración modificación una configuración que físicamente se almacena en ficheros XML. Para cada modo de inicio (Standalone o Domain Managed) existen diferentes configuraciones de inicio, en el caso de operar como servidor independiente. Estos ficheros se encuentran dentro de la carpeta correspondiente a la modalidad (domain o standalone).

-

standalone.xml Configuración por defecto, sin soporte JMS.

-

standalone-full.xml Añade soporte JMS (HornetQ).

-

standalone-ha.xml Soporte Clustering.

-

standalone-full-ha.xml Soporte Clustering y JMS.

Se puede especificar un fichero de configuración específico, distinto de la configuración por defecto con el parámetro "-c"

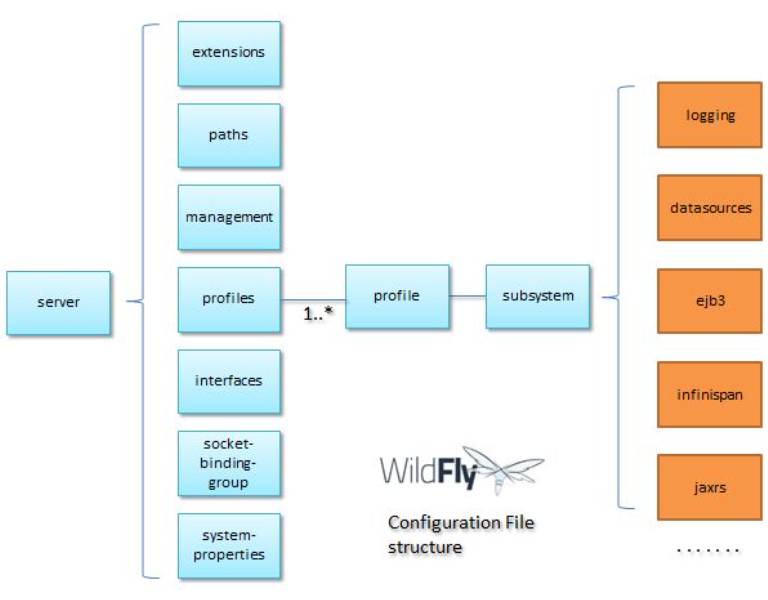

./standalone.sh -c standalone-full.xmlLos ficheros de configuración presentan la siguiente estructura:

El elemento raíz es la etiqueta <server> y de ella cuelgan los siguientes elementos:

- Profiles

-

Los perfiles son configuraciones de servidor y sus distintos subsistemas. En la modalidad standalone, Wildfly sólo permite un perfil por fichero de configuración, sin embargo en el modo domain, es posible definir varios perfiles para distintos tipos de servidores dentro de un dominio. Ejemplo:

<profile>

...

<subsystem xmlns="urn:jboss:domain:deployment-scanner:2.0">

<deployment-scanner path="deployments" relative-to="jboss.server.base.dir" scan-interval="5000"/>

</subsystem>

...

</profile>- Extensions

-

La mayor parte de las funcionalidades de WildFly se configuran como extensiones, que implementan especificaciones de Java EE.

<extensions>

[...]

<extension module="org.jboss.as.transactions"/>

<extension module="org.jboss.as.web" />

<extension module="org.jboss.as.webservices" />

<extension module="org.jboss.as.weld" />

</extensions>- Paths

-

Los paths son rutas a directorios o ficheros de la máquina a las que se les asocia un nombre lógico. Los paths pueden ser rutas absolutas o relativas a otro path, de modo que la configuración sea portable a otras máquinas:

<path name="log.dir" path="/home/wildfly/logs" /> <!-- Ruta absoluta -->

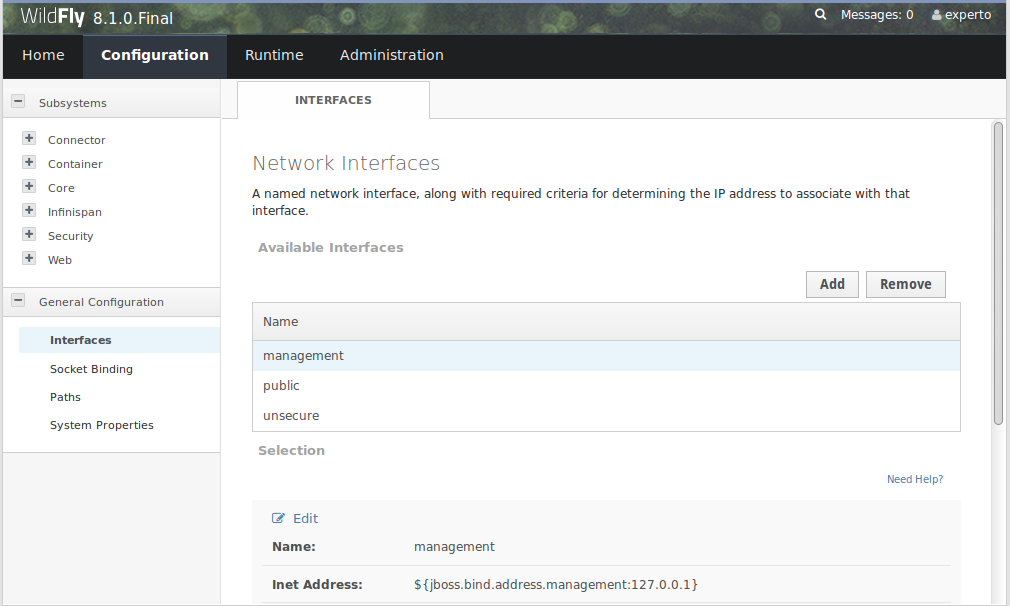

<file relative-to="log.dir" path="server.log"/> <!-- Ruta relativa a log.dir -->- Interfaces

-

Una interfaz es un nombre lógico asociado a un nombre de máquina/dirección IP a través de la cual podemos acceder a nuestro servidor. Por defecto se definen tres interfaces:

-

management La dirección que se utilizará para atender peticiones de administración.

-

public Esta es la dirección de servicio que atenderá el acceso a las aplicaciones.

-

unsecure Esta es la dirección que se utilizará para la invocación de objetos remotos IIOP.

-

<interface name="management">

<inet-address value="${jboss.bind.address.management:127.0.0.1}"/>

</interface>

<interface name="public">

<inet-address value="${jboss.bind.address:127.0.0.1}"/>

</interface>

<interface name="unsecure">

<inet-address value="${jboss.bind.address.unsecure:127.0.0.1}"/>

</interface>Por defecto estas interfaces están vinculadas a propiedades del sistema, que se pueden incluso sobrescribir en el inicio del servidor:

./standalone.sh -Djboss.bind.address=192.168.1.100- Socket binding groups

-

Un socket binding es básicamente la definición de un punto de escucha y se compone de la interfaz y del puerto de red concreto que se va a utilizar.

<socket-binding-group name="standard-sockets" default-interface="public" port-offset="${jboss.socket.binding.port-offset:0}">

<socket-binding name="management-http" interface="management" port="${jboss.management.http.port:9990}"/>

<socket-binding name="management-https" interface="management" port="${jboss.management.https.port:9993}"/>

<socket-binding name="ajp" port="${jboss.ajp.port:8009}"/>

<socket-binding name="http" port="${jboss.http.port:8080}"/>

<socket-binding name="https" port="${jboss.https.port:8443}"/>

<socket-binding-group/>El parámetro port-offset se utiliza para desplegar en una misma máquina distintas instancias de un servidor y asignar a cada una de ellas puertos distintos. El valor del offset se suma a todos los puertos especificados. Una buena práctica es establecer el valor de offset como propiedad del sistema en el inicio, en lugar de indicarlo de forma estática en la configuración.

- System properties

-

Estas propiedades de configuración del servidor, se pueden establecer de varias formas:

-

En el fichero de configuración

-

<system-properties>

<property-name="propiedad" value="true" />

</system-properties>-

En el script de arranque del servidor standalone.sh o domain.sh.

-

Por línea de comandos, con elparámetro -D

./standalone.sh -Dpropiedad=true2.3. Edición desde las herramientas de administración

Como ya hemos comentado, la forma más segura de modificar la configuración, es a través de las herramientas de configuración. Uno de los beneficios que reporta utilizar las herramientas es que WildFly crea automáticamente copias de seguridad de la configuración, por si nos equivocamos en algún cambio.

Sin embargo, en el caso concreto de JBoss, la edición de ficheros de configuración ha sido tradicionalmente la forma más efectiva de administración. Gracias a JBoss AS 7 y WildFly, las herramientas de administración comienzan a acercarse al nivel de otros productos.

|

Descriptores de despliegue

Además de editar los ficheros de configuración del servidor, es posible codificar la mayor parte de los recursos en ficheros denominados descriptores de despliegue. Los descriptores de despliegue de WildFly complementan a los descriptores estándar de Java EE y permiten utilizar todas las características del servidor. Más información en: https://docs.jboss.org/author/display/WFLY8/Deployment+Descriptors+used+In+WildFly

|

La consola Web es una aplicación ligera que genera de forma automática vistas sobre la estructura de los ficheros de configuración, con lo que si conocemos la estructura del fichero, la representación Web nos resultará familiar:

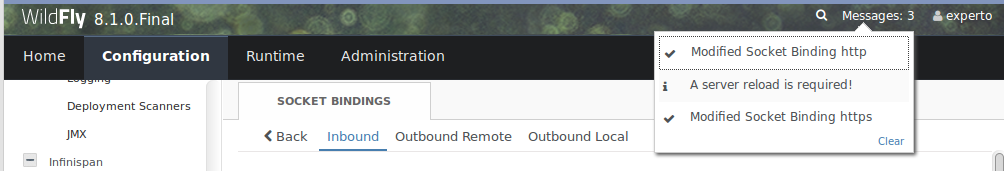

Cuando modifiquemos algunas propiedades que requieran recargar la configuración, la aplicación nos avisará:

La recarga de la configuración la podemos realizar desde la pestaña Runtime, opción Server.

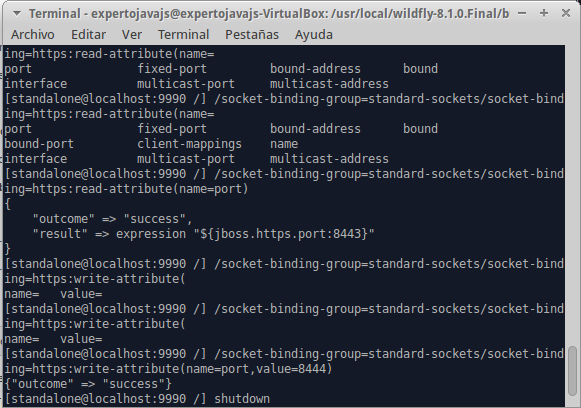

Desde CLI, los cambios se pueden realizar más rápidamente, gracias a la forma de navegar y la ayuda para autocompletar rutas:

Después de realizar cambios en la configuración, ésta se puede recargar mediante el comando reload o bien parando y arrancando de nuevo el servidor.

2.4. Configuración de recursos

La función más importante de un servidor de aplicaciones es la de proporcionar los recursos necesarios para que las aplicaciones puedan funcionar. A continuación repasaremos cómo configurar los recursos más habituales.

2.4.1. Configuración de Datasources

Para que las aplicaciones puedan tener acceso a base de datos previamente hay que definir un Datasource y un Pool de conexiones. El Pool de conexiones optimiza el acceso a base de datos creando un conjunto de conexiones antes de que las aplicaciones las lleguen a necesitar. El servidor de aplicaciones asigna estas conexiones dinámicamente a las aplicaciones y en cada asignación nos ahorramos el tiempo de conexión/desconexión a la base de datos.

Las propiedades más importantes que definen el comportamiento de un Pool de conexiones en Wildfly son:

- Min Pool Size

-

El número mínimo de conexiones creadas que puede tener un pool.

- Max Pool Size

-

El número maximo de conexiones creadas que puede tener un pool.

- Strict Minimum

-

Si se activa, impide que el número de conexiones pueda bajar más allá del mínimo definido (por ejemplo si las sesiones se liberan por timeout).

- Prefill Enabled

-

Si se activa, al iniciar un pool de conexiones se crean automáticamente el numero de conexiones indicado como mínimo.

- Flush Strategy

-

Especifica el modo en el que se liberan las conexiones de un pool ante un error.

- Idle Timeout

-

Especifica el tiempo en minutos que se puede mantener una conexión sin uso, antes de ser liberada.

Para poder crear una conexión a base de datos en primer lugar hay que instalar el driver jdbc correspondiente. Esto se puede hacer de dos formas:

Instalación del driver como módulo

-

Crear una estructura de directorio dentro de JBOSS_HOME/modules. En el caso de MySQL debemos crear:

JBOSS_HOME/modules/system/layers/base/com/mysql/driver/main -

Copiar el Jar dentro de la carpeta main

-

Crear un descriptor module.xml dentro de la carpeta main:

<module xmlns="urn:jboss:module:1.3" name="com.mysql.driver"> <resources> <resource-root path="mysql-connector-java-5.1.33.jar" /> </resources> <dependencies> <module name="javax.api"/> <module name="javax.transaction.api"/> </dependencies> </module> -

Declarar el driver en el fichero standalone.xml. Añadir al subsistema datasources el nuevo driver

<driver name="mysql" module="com.mysql.driver">

<driver-class>com.mysql.jdbc.Driver</driver-class>

</driver>Instalación del driver como despliegue

Si no tenemos permisos de administración, podemos simplemente copiar el fichero .jar con el driver de MySQL a la carpeta deployments del servidor. Al iniciar WildFly debemos revisar el nombre exacto del driver con el que se publica por si lo necesitamos referenciar en la creación de un datasource.

NOTE: El jar lo podéis descargar desde la página de MySQL o bien desde aquí: http://central.maven.org/maven2/mysql/mysql-connector-java/5.1.33/mysql-connector-java-5.1.33.jar

2.4.2. Creación del Datasource y los pool

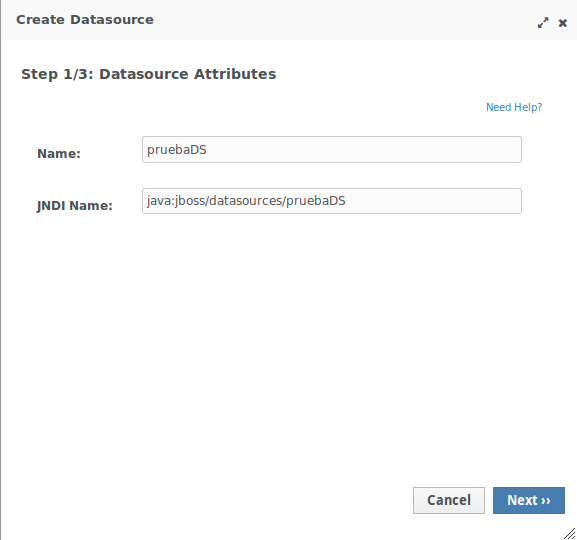

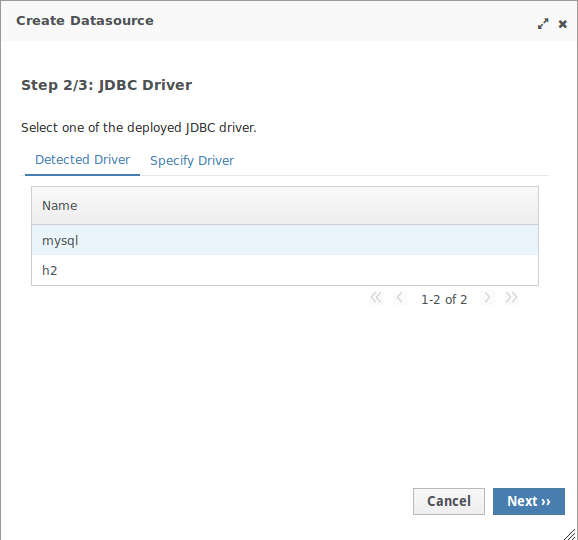

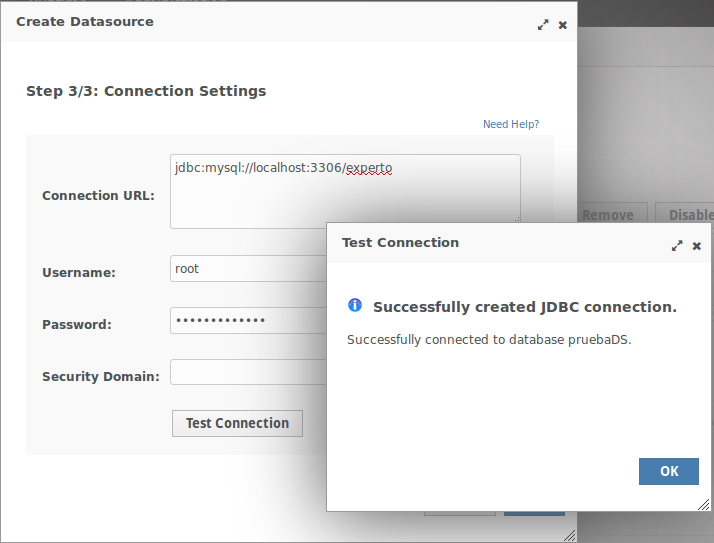

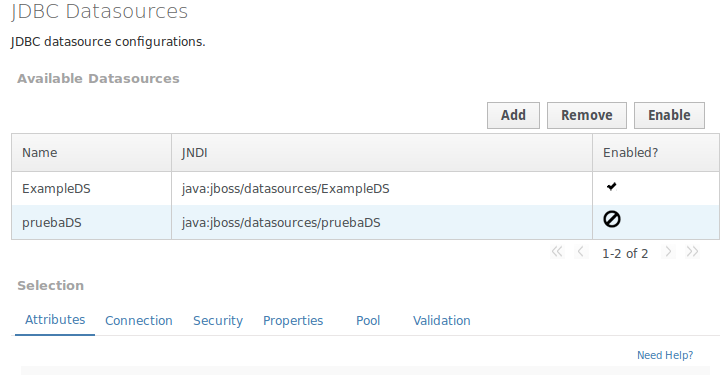

Nuevamente tenemos varias formas de configurar un Datasource, a continuación veremos los pasos para configurarlo desde la consola Web:

-

Definir el nombre del pool y el nombre JNDI del Datasource

-

Seleccionar un driver de los instalados en el servidor:

-

Configurar la cadena de conexión y el usuario/password.

-

Activar el nuevo pool

|

¿Se puede desplegar un Datasource como un Deployment?

Si, se puede crear un fichero *-ds.xml con la configuración de uno o mas datasources. El fichero tiene la misma estructura que la del subsistema datasources del fichero standalone.xml y se puede copiar directamente a la carpeta deployments, o bien empaquetar dentro de una aplicación. Esta forma de crear datasources es recomendable en entornos de desarrollo, si bien, desde la consola web no es posible administrar este tipo de datasources.

|

<?xml version="1.0" encoding="UTF-8"?>

<datasources>

<datasource jta="false" jndi-name="java:jboss/datasources/portalDS" pool-name="portalDS" enabled="true" use-ccm="false">

<connection-url>jdbc:mysql://localhost:3306/experto</connection-url>

<driver-class>com.mysql.jdbc.Driver</driver-class>

<driver>mysql</driver>

<security>

<user-name>root</user-name>

<password>expertojavajs</password>

</security>

<validation>

<validate-on-match>false</validate-on-match>

<background-validation>false</background-validation>

</validation>

<statement>

<share-prepared-statements>false</share-prepared-statements>

</statement>

</datasource>

</datasources>Empaquetar Datasources en la aplicación:

Como hemos comentado el Datasource puede incluirse en las propias aplicaciones. Eso sí, la ubicación del fichero varía en función del tipo de aplicación:

| Tipo Aplicación | Ubicación |

|---|---|

Web App (.war) |

WEB-INF |

EJB (.jar) |

META-INF |

Enterprise (.ear) |

META-INF (empaquetado principal) |

Encriptación del password

WildFly tiene la particularidad de trabajar con passwords en plano en lo que respecta a Datasources. Si la configuración está centralizada en el fichero standalone.xml puede no ser un problema si está protegido para que no sea accesible. Sin embargo si adjuntamos un datasource a una aplicación, o lo copiamos en la carpeta deployments puede ser muy sencillo el averiguar el usuario y la clave de la base de datos. La forma de evitar esto es trabajar con claves encriptadas.

Los pasos son los siguientes:

expertojavajs@expertojavajs-VirtualBox:/usr/local/wildfly-8.2.1.Final/modules/system/layers/base/org/picketbox/main$ java -classpath picketbox-4.0.21.Final.jar org.picketbox.datasource.security.SecureIdentityLoginModule expertojavajs

Encoded password: -46cea3eadea6ff81c9c59e773c1cfb95Para ello debemos definir un security domain en el servidor, editando el fichero standalone.xml y añadiendo la siguiente información dentro del subsistema urn:jboss:domain:security:

<security-domain name="ds-encrypted" cache-type="default">

<authentication>

<login-module code="org.picketbox.datasource.security.SecureIdentityLoginModule"

flag="required">

<module-option name="username" value="root"/>

<module-option name="password" value="-46cea3eadea6ff81c9c59e773c1cfb95"/>

<module-option name="managedConnectionFactoryName"

value="jboss.jca:service=LocalTxCM,name=portalDS"/>

</login-module>

</authentication>

</security-domain><security>

<security-domain>ds-encrypted</security-domain>

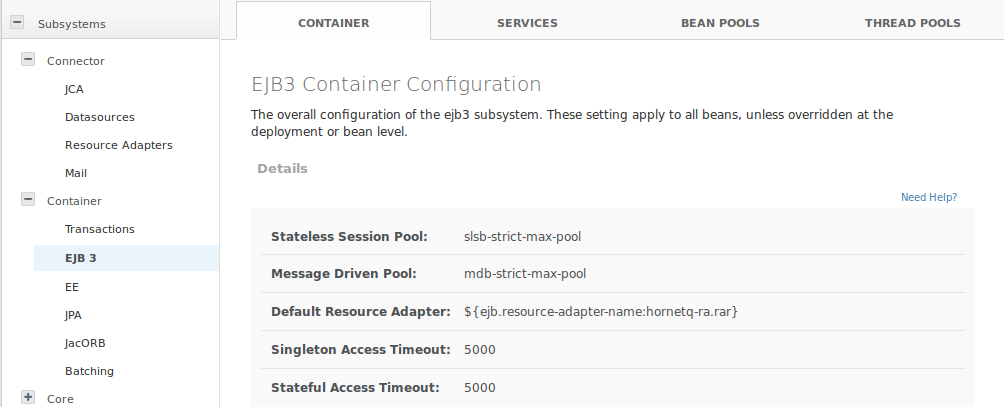

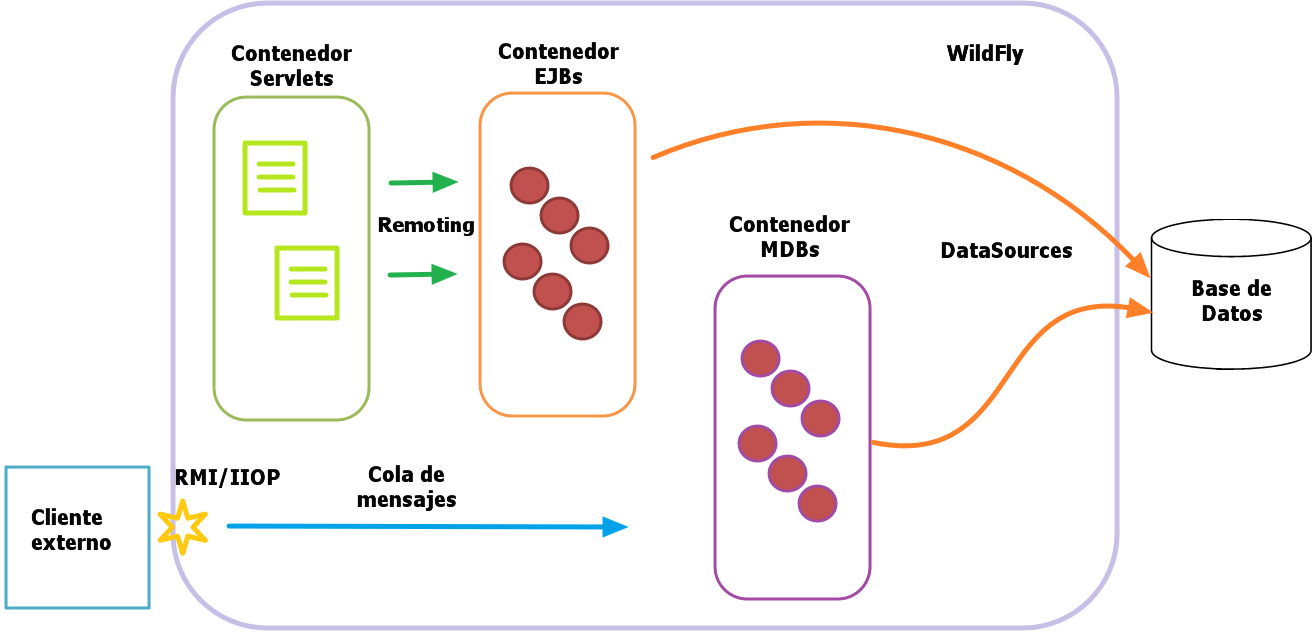

</security>2.4.3. Configuración del contenedor de EJB’s

Los EJB son componentes que implementan principalmente la lógica de negocio de una aplicación Java EE y el servidor de aplicaciones proporciona mecanismos para maximizar la capacidad de proceso de estos componentes.

Los EJB’s se dividen en tres tipos:

- Stateless Session Beans

-

Son objetos que implementan funciones de negocio pero no tienen un estado (valores en memoria).

- Stateful Session Beans

-

Son objetos que implementan funciones de negocio pero además tienen un estado, que se conserva durante la vida de la sesión.

- Message Driven Beans

-

Son objetos especializados en el proceso asíncrono de mensajes.

Los Session Beans se pueden instanciar desde cualquier componente de nuestra aplicación que se encuentre en el servidor (servlets, otros EJb’s, etc.) pero también se pueden ejecutar desde procesos externos al servidor, mediante el protocolo Remoting (basado en RMI). Los objetos MDB son componentes especializados que sólo se ejecutan en respuesta a mensajes enviados asíncronamente a través de lo que se denomina tópico o cola de mensajes.

Pool de EJB’s

Los EJB’s son esencialmente POJO’s a los que se les añade anotaciones específicas para integrarlos dentro del ciclo de vida del contenedor de EJB’s. Así los objetos EJB se crean y se destruyen en función de la carga de trabajo. Al igual que ocurre con las conexiones a base de datos podemos definir el número de instancias de estos objetos de modo que podamos controlar los recursos destinados a ejecutar esta lógica de negocio. Esto es muy útil en momentos de picos de carga en los que un número excesivo de EJB’s en ejecución pueden degradar notablemente el rendimiento global del servidor.

Este mecanismo es factible para los objetos que no tienen estado, como los Stateless Session Bean y los Message Driven Beans, pero los stateful son objetos equiparables a la sesión HTTP: contienen información de trabajo que no se puede copiar de una sesión a otra. En este caso hay mecanismos que agilizan la carga de la información, pero en ningún caso se puede crear un pool de objetos.

|

Pool de Objetos en WildFly

Antes de esta versión, existía una configuración de pool de objetos por defecto que aplicaba a todos los Stateless Session Bean. En WildFly por defecto el pool de objetos está desactivado pues se entiende que hoy en día la mejora de rendimiento derivada del pooling no es tan evidente y el uso como contención de capacidad de proceso dependerá de cada aplicación, y por tanto es responsabilidad del desarrollador (o administrador) el parametrizar estos valores. En el caso de MDB’s sigue estando activo un pool por defecto.

|

Para habilitar el pool por defecto slsb-strict-max-pool (límite de 20 instancias y timeout de acceso de 5 minutos) hay que editar el fichero de configuración añadiendo:

<subsystem xmlns="urn:jboss:domain:ejb3:2.0">

<session-bean>

<stateless> <!-- Añadir tag stateless-->

<bean-instance-pool-ref pool-name="slsb-strict-max-pool"/>

</stateless>

Para definir un nuevo pool podemos hacerlo desde CLI o a mano editando el fichero de configuración.

-

Desde CLI, el comando sería el siguiente:

[standalone@localhost:9990 /] /subsystem=ejb3/strict-max-bean-instance-pool=nuevo-pool:add(max-pool-size=5,timeout-unit=SECONDS,timeout=30)Con este comando definiremos un nuevo pool de hasta 5 instancias

El resultado en el fichero standalone-full.xml es el siguiente:

<subsystem xmlns="urn:jboss:domain:ejb3:2.0">

....

<pools>

<bean-instance-pools>

<strict-max-pool name="nuevo-pool" max-pool-size="5" instance-acquisition-timeout="30" instance-acquisition-timeout-unit="SECONDS"/>

....Para asociar un pool a un EJB concreto, basta añadir una anotación en la clase correspondiente indicando el nombre del pool:

@Stateless

@Pool (value="ranking-pool")

public class Ranking implements RankingLocal {2.4.4. Descriptores de despliegue

Java Enterprise proporciona dos métodos para especificar aspectos de la configuración de una aplicación:

-

Descriptores de despliegue (Ficheros XML).

-

Anotaciones en código.

Sin embargo hay propiedades especificas de Wildfly (comportamiento de los EJB’s del servidor Web Undertow, etc.) que no quedan cubiertas por el estándar Java EE y que pueden ser definidas desde la aplicación mediante ficheros de configuración propietarios. En la sección de referencias se encuentra un enlace a la lista de descriptores de WildFly, que a la fecha de este documento no estaba completa (se podría utilizar los propios de JBoss 7.1).

2.4.5. Class Loading

En este apartado trataremos brevemente el orden que sigue el servidor a la hora de localizar las clases que componen una aplicación. En la sesión anterior comentamos los distintos tipos de aplicaciones java y la forma de acceder a componentes compartidos. JBoss proporciona un mecanismo adicional: el uso de módulos.

Los módulos se dividen a su vez en

- Módulos estáticos

-

se integran en las carpetas de módulos del servidor y pueden ser definidos como accesibles por todos los despliegues del servidor.

- Módulos dinámicos

-

Se copian a la carpeta deployments y pueden ser reemplazados en caliente.

Si recordamos el caso del driver de MySQL veremos que hemos propuesto dos instalaciones, una como módulo estático y otra como módulo dinámico. Por defecto si añadimos un módulo dinámico, el nombre interno que tendrá el módulo en WildFly será:

deployment.[nombre del fichero]La forma de especificar que una aplicación necesita acceder a recursos de un módulo, (estático o dinámico) es indicarlo en el fichero MANIFEST.MF

Dependencies: deployment.WebExample1.warPor último, comentar el orden que sigue WildFly para resolver la ubicación de una clase Java. Ordenando de mayor prioridad a menor:

-

Dependencias del sistema: Son dependencias que el contenedor añade de forma automática a la aplicación, como por ejemplo el API de Java EE.

-

Dependencias de usuario: Son las que el desarrollador define a través del MANIFEST.MF, el Classpath para ficheros JAR o a través del fichero jboss-deployment-structure.xml.

-

Recursos locales. Son las clases que están ubicadas dentro del propio empaquetado de la aplicación, por ejemplo WEB-INF/classes o WEB-INF/lib de una aplicación WAR.

-

Dependencias compartidas. Son las dependencias compartidas entre varios componentes de una aplicación. Típicamente las librerías compartidas dentro de una aplicación EAR.

2.4.6. Rendimiento

Hablar de rendimiento en un servidor de aplicaciones nos permitiría llenar más de una sesión entera del curso, si bien, lo más importante es dimensionar los recursos del servidor (memoria, pool de objetos, conexiónes a base de datos) en función de la carga de trabajo que va a soportar. Dado que gran parte de la programación que se verá en el curso gira en torno a JavaScript, comentar que hay una forma muy sencilla de agilizar los tiempos de carga de las aplicaciones y consiste en habilitar la compresión GZIP en las comunicaciones con el servidor. Descargar con compresión código JavaScript o texto estático en HTML puede reducir el tiempo de descarga hasta un 90%, a costa de un mayor consumo de CPU en el servidor.

La forma de habilitarlo en WildFly consiste en definir un filtro y según el tipo de recurso aplicar compresión o no (es contraproducente comprimir recursos estáticos ya comprimidos como imágenes o documentos PDF).

<subsystem xmlns="urn:jboss:domain:undertow:1.0">

<buffer-caches>

<buffer-cache name="default" buffer-size="1024" buffers-per-region="1024" max-regions="10"/>

</buffer-caches>

<server name="default-server">

<http-listener name="default" socket-binding="http"/>

<host name="default-host" alias="localhost">

<location name="/" handler="welcome-content" />

<filter-ref name="gzipFilter" predicate="path-suffix['.css'] or path-suffix['.js']" />

<filter-ref name="server-header"/>

<filter-ref name="x-powered-by-header"/>

</host>

</server>

<servlet-container name="default" default-buffer-cache="default" stack-trace-on-error="local-only">

<jsp-config/>

</servlet-container>

<handlers>

<file name="welcome-content" path="${jboss.home.dir}/welcome-content" directory-listing="true"/>

</handlers>

<filters>

<response-header name="server-header" header-name="Server" header-value="Wildfly 8"/>

<response-header name="x-powered-by-header" header-name="X-Powered-By" header-value="Undertow 1"/>

<gzip name="gzipFilter"/>

</filters>

</subsystem>Se añade la referencia al filtro gzipFilter en la lista de filtros y en el tag <filter-ref name> se define la expresión regular que determina si un elemento se debe comprimir o no.

2.5. Referencias

-

WildFly Administration Guide https://docs.jboss.org/author/display/WFLY8/Admin+Guide

-

Quickstart JMS http://www.mastertheboss.com/jboss-jms/how-to-code-a-remote-jms-client-for-wildfly-8

-

Descriptores de despliegue estándar Java EE 7 https://wikis.oracle.com/display/GlassFish/Java+EE+7+Maven+Coordinates

-

Descriptores de despliegue específicos de WildFly https://docs.jboss.org/author/display/WFLY8/Deployment+Descriptors+used+In+WildFly

-

Configuración de los Pool de EJB en JBoss 7 http://www.javacodegeeks.com/2011/11/jboss-as-7-ejb3-pools-configuration.html

-

Información sobre el ClassLoading en JBoss 7 https://docs.jboss.org/author/display/AS71/Class+Loading+in+AS7

-

Best Practices for speeding up your Web Site https://developer.yahoo.com/performance/rules.html

-

GZip Encoding in WildFly http://rumianom.pl/rumianom/entry/gzip_content_encoding_in_wildfly

2.6. Ejercicios de Administración de recursos en Wildfly

|

JMS y WildFly

Para que se pueda acceder a determinados recursos como las connection factory o colas del servidor desde un proceso externo, hay que utilizar un nombre JNDI adicional que comience por java:jboss/exported. El cliente jboss-client de WildFly 8.x no implementa JMS 2.0, si no que se corresponde con la especificación Java EE 6.0 La clase genérica Destination no está definida.

|

Ahora que ya tenemos una visión general sobre la configuración de recursos en WildFly, vamos a realizar una serie de ejercicios para poner en práctica lo que hemos aprendido.

2.6.1. Librería compartida de Logs (0.6 puntos)

Vuestro primer reto será crear una sencilla librería de log, que registre cualquier evento en una tabla de base de datos. Un evento tendrá los siguientes atributos: timestamp, un mensaje y un tipo: I:informativo, D:debug W:aviso E:error.

Debéis realizar las siguientes tareas:

-

Iniciar WildFly en modo standalone en modo Full Profile Java EE (standalone-full.xml).

-

Desplegar la libreria _apli-loglibrary- como librería compartida, que contiene las clases necesarias para implementar la interfaz de log.

-

Definir el datasource java:jboss/datasources/appLogger en un descriptor de despliegue con el password encriptado, que se debe incluir en la propia librería.

-

Desplegar una sencilla aplicación Web con un único Servlet que registre en base de datos cada llamada que reciba. Debe enlazar externamente con la librería de logs.

Se os proporciona un script eurovision.sql con la tabla de logs y la base de datos para el siguiente ejercicio. También contaréis con los tres proyectos Maven que componen esta aplicación:

-

Proyecto "Java Application" de nombre apli-logLibrary con la interfaz de Log predefinida.

-

Proyecto "Web Application", apli-AppLogger, con el servlet de prueba: se invocará mediante la llamada a http://localhost:8080/App/Test

-

Proyecto "Enterprise Application" apli-Enterprise Logger que incluirá únicamente al proyecto Web.

Debéis desplegar tanto la librería compartida como el EAR y comprobar que se registran en la tabla las llamadas al servlet. Los entregables serán los fuentes de todos los proyectos.

|

Pistas

Si queréis probar la librería sin desplegarla en WildFly debéis utilizar el denominado cliente completo de WildFly. Es un jar que se utiliza en clientes pesados que incluye todas las clases de WildFly necesarias para trabajar en remoto.

|

Para dar de alta el cliente de WildFly como una dependencia de Maven hay que hacer lo siguiente:

-

Acceder a la carpeta /usr/local/wildfly-8.2.1.Final/bin/client .

-

Ejecutar:

mvn install:install-file -Dfile=jboss-client.jar \ -DgroupId=org.wildfly \ -DartifactId=jboss-client \ -Dversion=8.2.1 \ -Dpackaging=jar \ -DgeneratePom=true

2.6.2. Camino a Eurovisión (1 punto)

Tenemos la tarea de desplegar un sistema de votaciones que se utilizará para determinar la próxima canción candidata española a Eurovisión. Esta aplicación presenta una estructura de proyectos típica de las aplicaciones Java Entreprise de hace algunos años. Se trata de una aplicación EAR con distintos subproyectos para cada uno de los módulos que contiene y un pom principal que compila toda la solución. Esta basada en Java EE 5 aunque tiene referencias a las librerías actuales. En resumen, algo muy parecido a lo que os podéis encontrar en el mundo laboral. Los módulos son los siguientes:

-

Una librería con un EJB que implementa la lógica de negocio.

-

Una aplicación Web que implementa la presentación.

-

Una aplicación empresarial EAR que engloba a todo el proyecto.

-

Un cliente Java EE externo.

Gráficamente, la arquitectura de la aplicación es la siguiente:

Se utiliza una aplicación externa para simular una pasarela que recoge los votos emitidos mediante mensajes de móvil. La información que os interesará de dichos mensajes es el número de teléfono origen y el número de la canción votada. El formato del mensaje será el teléfono, de longitud variables, el símbolo "#" como separador y por último la palabra EURO más un número del 01 al 12, ejemplo: 654736534#EURO04.

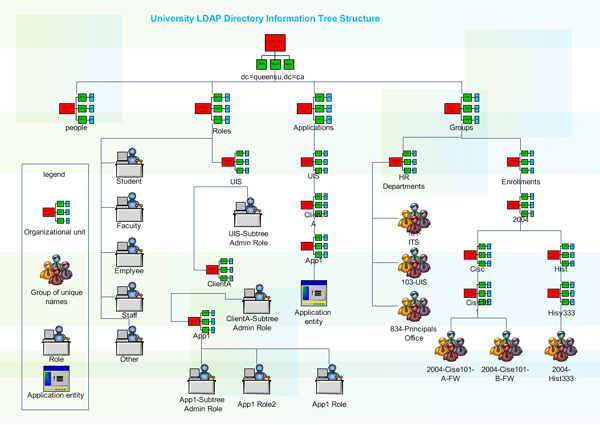

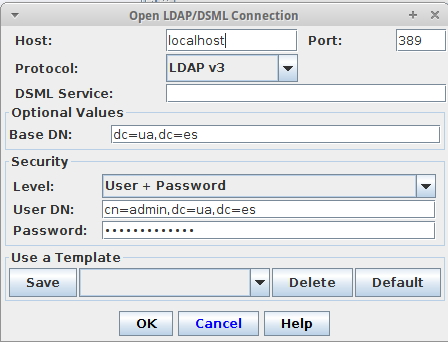

Partiréis de los proyectos Maven ya creados y un script SQL para la creación de la base de datos eurovision. Aunque no se estudia en detalle en esta sesión, dentro de la aplicación tenemos un ejemplo de procesamiento asíncrono mediante colas de mensajes y objetos MDB’s. Para que esta parte funcione correctamente hay que crear un usuario de aplicación denominado jmsuser. Para que este nuevo usuario tenga permisos de lectura/escritura hay que asociarlo al grupo guest.

Para completar el ejercicio teneis que cubrir los siguientes objetivos:

-

Configurar la aplicación EAR para que utilice la librería compartida de logs del ejercicio anterior.

-

Ajustar la configuración del EJB Ranking que implementa la lógica de negocio añadiéndole un límite máximo de 5 objetos simultáneos para el EJB. Como esta configuración es específica de WildFly hay que añadir la siguiente dependencia al proyecto del EJB:

<dependency> <groupId>org.wildfly</groupId> <artifactId>wildfly-ejb3</artifactId> <version>8.2.1.Final</version> <scope>provided</scope> </dependency> -

La aplicación contiene un MDB que recibe los votos y los almacena en base de datos. Hay que revisar cómo está implementado y crear la conexión a base de datos que necesita desde la consola de WildFly.

-

Configurar el usuario JMS que utilizará el cliente Java apli-EnvioSMS. Se trata de una aplicación Java EE que se ejecuta fuera del servidor de aplicaciones pero utiliza los servicios que ofrece, concretamente una cola JMS, denominada jms/entradaMensajes a donde enviará los votos del

-

Desplegar la aplicación y acceder a la consulta de votaciones para ver las posibles canciones a las que se puede votar.

-

Utilizar la aplicación cliente para enviar varios votos y asegurarse de que se contabilizan correctamente.

Los entregables del ejercicio serán:

-

El fichero de configuración standalone-full.xml

-

El código fuente de todos los proyectos solicitados, apli-EnvioSMS y Apli-CaminoAEurovision.

|

Pistas

Para poder compilar la aplicación externa Java EE necesitaréis construir el cliente completo de WildFly, tal y como se explicaba en el ejercicio anterior. Estad muy pendientes del log de WildFly, que es donde se os dará una pista más clara de lo que ocurre en caso de problemas.

|

3. Seguridad declarativa en WildFly (JAAS)

Desde el punto de vista del programador, no hay grandes diferencias a la hora de desarrollar y desplegar una aplicación en WildFly, GlassFish u otro servidor de aplicaciones, pero es desde la perspectiva del administrador desde donde cada producto muestra una forma diferente de operar. Desde este punto de vista hemos querido cubrir los aspectos más generales del uso de WildFly. A partir de ahora nos centraremos en la seguridad.

En esta sesión hablaremos sobre seguridad en declarativa en WildFly y en la siguiente hablaremos de seguridad en la capa de transporte

3.1. Implementación de la seguridad declarativa en WildFly

A estas alturas ya tenemos una idea general sobre seguridad declarativa, pero como repaso vamos a revisar una serie de conceptos que enlazan lo que ya hemos visto con algunos elementos nuevos:

- Usuarios, grupos y roles

-

Son los elementos básicos a la hora de definir la seguridad de una aplicación Web y que ya hemos utilizado a lo largo del curso. En el caso concreto de WildFly, grupo y rol se tratan como un mismo concepto, como veremos más adelante.

- Políticas de seguridad

-

Son asociaciones entre recursos de WildFly y usuarios o roles. Es decir nos permiten definir exactamente quién puede acceder a un determinado recurso y qué operaciones puede hacer con él.

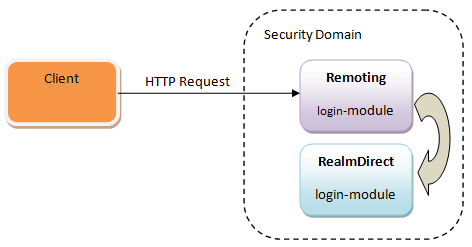

- Dominios de seguridad (Security Domains)

-

Son las configuraciones de autenticación, autorización, mapeo de seguridad y auditoría propias del servidor de aplicaciones. Implementan la especificación JAAS (Java Authentication and Authorization Service) de seguridad declarativa.

- Security Realms

-

Los Realm son los almacenes de usuarios, password y roles de las interfaces de administración del servidor (puntos de entrada) tanto desde el exterior como internamente en el propio servidor. Son componentes sobre los que se sustentan los security domain. De inicio WildFly cuenta con dos Security Realm:

-

ManagementRealm: que sirve para securizar el acceso a las herramientas de administración (Autenticación)

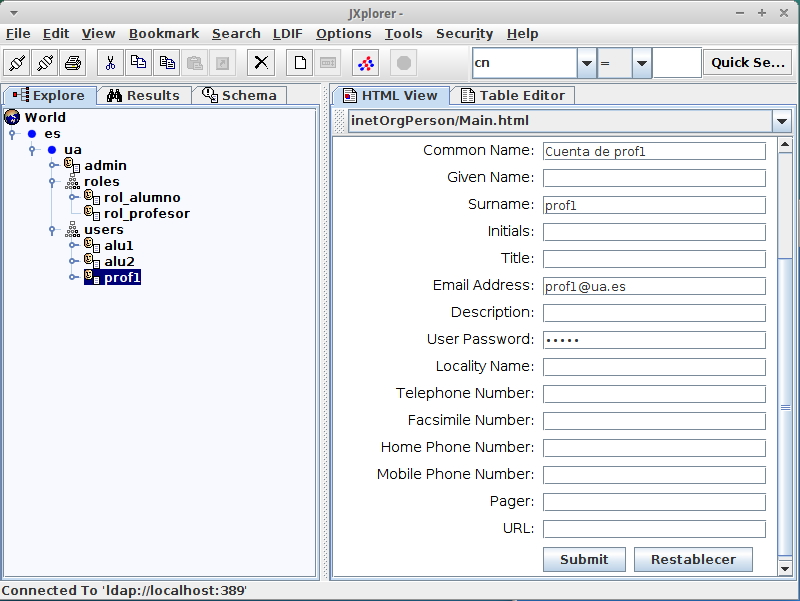

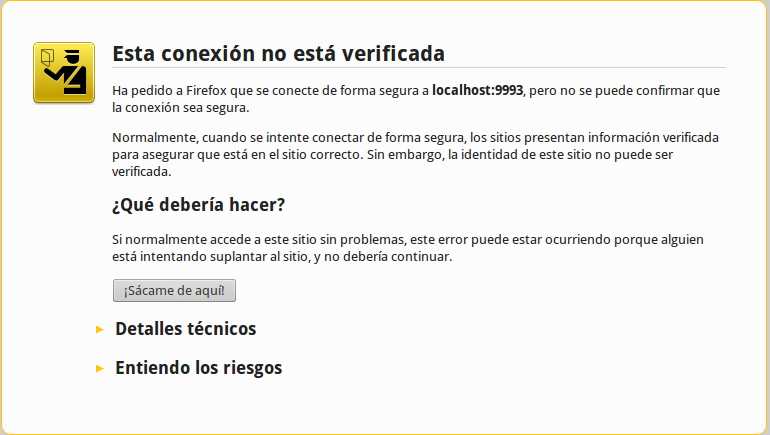

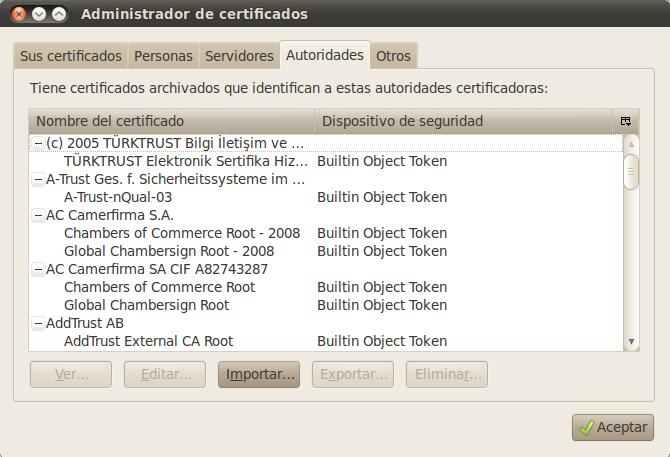

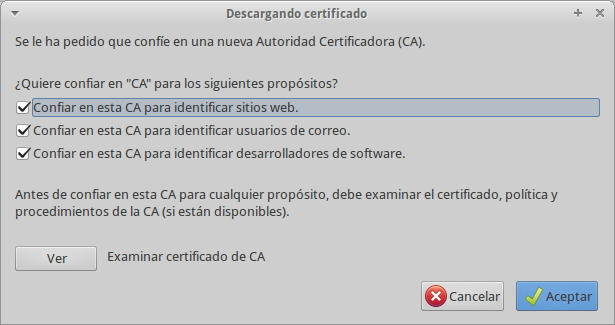

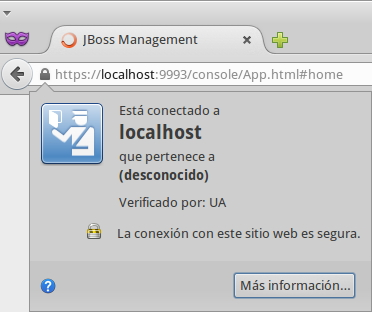

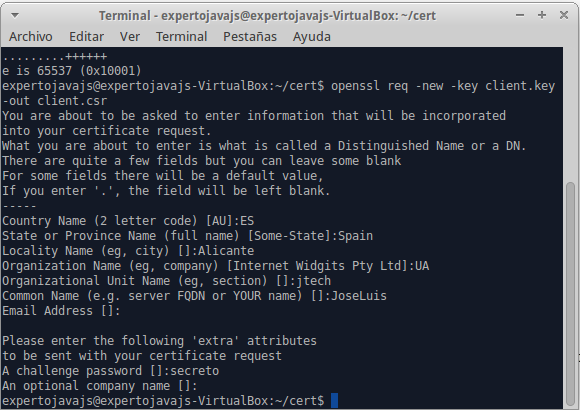

-